Le patron d’Instagram estime qu’il sera plus pratique d’identifier les humains que les IA

« Le vrai est un moment du faux » (La société du spectacle)

Le 05 janvier à 17h01

Les fulgurantes avancées en matière de contenus générés par IA, notamment (audio)visuels, rendront de plus en plus difficile le fait d’identifier ceux qui cherchent à imiter voire usurper des contenus humains. Le patron d’Instagram propose dès lors de renverser la charge de la preuve, en identifiant plus formellement les contenus créés par des humains.

Le patron d’Instagram estime qu’il sera plus pratique d’identifier les humains que les IA

« Le vrai est un moment du faux » (La société du spectacle)

Les fulgurantes avancées en matière de contenus générés par IA, notamment (audio)visuels, rendront de plus en plus difficile le fait d’identifier ceux qui cherchent à imiter voire usurper des contenus humains. Le patron d’Instagram propose dès lors de renverser la charge de la preuve, en identifiant plus formellement les contenus créés par des humains.

IA et algorithmes

IA

8 min

« De plus en plus de personnes pensent qu’il sera plus pratique d’identifier les médias authentiques que les faux générés par IA », estime Adam Mosseri, l’ex-cadre supérieur de Facebook nommé patron d’Instagram depuis la démission de ses cofondateurs en 2018 : « Les fabricants d’appareils photo pourraient signer cryptographiquement les images au moment de la capture, créant ainsi une chaîne de contrôle ».

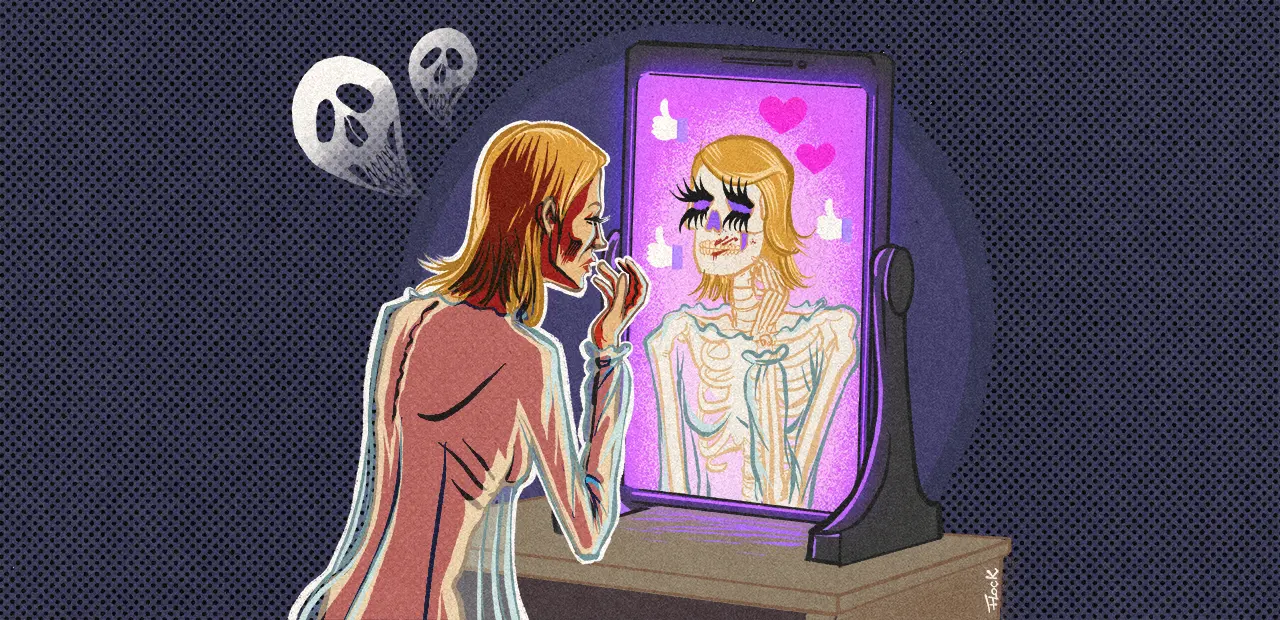

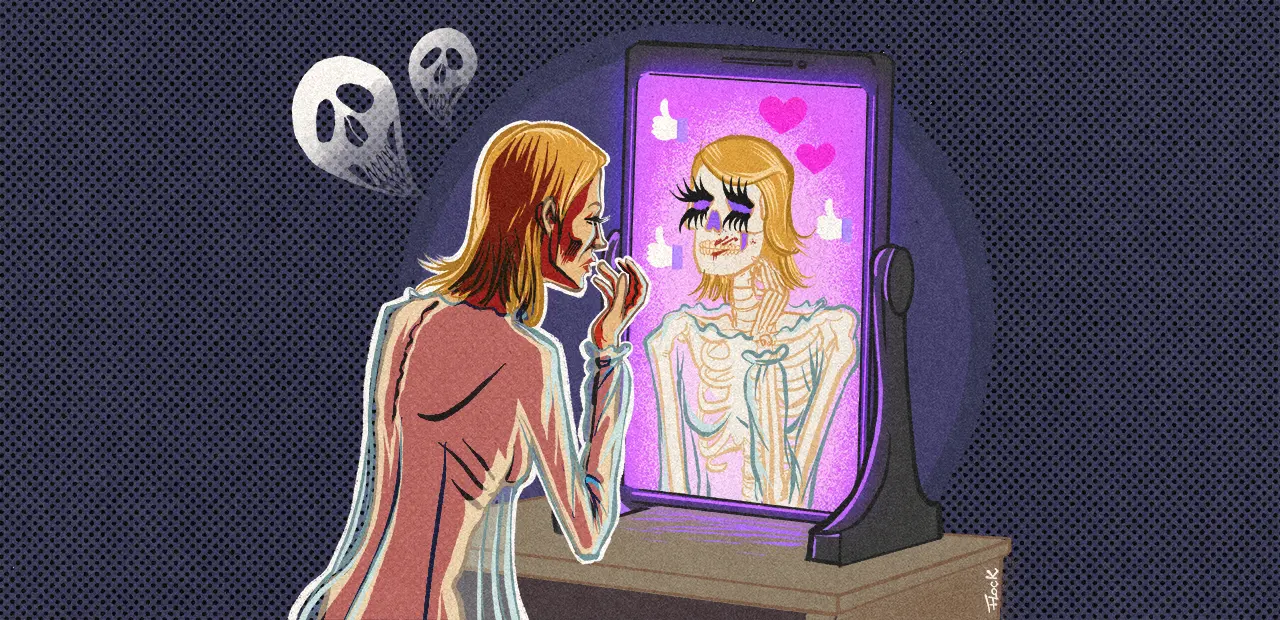

Dans un message partagé sur Insta et Threads, Adam Mosseri constate que « l’authenticité devient infiniment reproductible » du fait du perfectionnement des IA génératives. Ce pourquoi « le principal risque » auquel est confrontée une plateforme comme Instagram est qu’elle ne parvienne pas à suivre le rythme, et qu’elle finisse par être submergée de contenus générés par IA (GenAI) :

« Tout ce qui rendait les créateurs importants – leur capacité à être authentiques, à créer des liens, à avoir une voix qui ne pouvait être imitée – est désormais accessible à quiconque dispose des bons outils. Les deepfakes sont de plus en plus perfectionnés. L’IA génère des photos et des vidéos impossibles à distinguer des médias capturés [par des humains, ndlr]. Les flux commencent à se remplir de contenus synthétiques. »

Le pouvoir passe des institutions aux individus, et maintenant aux IA

Cherchant à anticiper ce qu’il pourrait faire pour ne pas être submergé, Adam Mosseri rappelle tout d’abord que « depuis des années, le pouvoir passe des institutions aux individus, car Internet permet à toute personne ayant une idée convaincante de trouver un public » :

« Le coût de la diffusion de l’information est pratiquement nul. Les gens peuvent donc désormais contourner les moyens traditionnels de diffusion de l’information (journaux distribués par camion, émissions produites pour la télévision) et s’adresser directement à leur public. On le constate dans tous les domaines, des athlètes qui sont plus importants que leurs équipes aux journalistes qui inspirent plus confiance que leurs publications. »

Alors que « la confiance dans les institutions (gouvernement, médias, entreprises) est en déclin depuis des décennies » et que nous sommes dans le même temps « submergés par le contenu produit à grande échelle par les institutions », « ce sont des individus, et non des éditeurs, des médias ou des marques », qui ont créé ce marché de créateurs de contenus autoproduits par des « personnes que nous admirons ».

L’authenticité devient une ressource rare

Évoquant les contenus synthétiques qui, d’ici quelques années, « seront bien plus nombreux que ceux capturés par des moyens traditionnels », le patron d’Instagram relève que, si l’on parle beaucoup de l’ « AI slop », « il existe heureusement beaucoup de contenus IA incroyables [et] de qualité ».

Il constate cela dit que les contenus générés par IA sont « de plus en plus réalistes » et que « l’authenticité devient une ressource rare », ce qui, d’après lui, va entraîner une augmentation de la demande de contenus créés par des humains. Il estime aussi que « les créateurs qui réussiront seront ceux qui trouveront le moyen de préserver leur authenticité, qu’ils adoptent ou non les nouvelles technologies » :

« Cela devient plus difficile (et non pas plus facile) aujourd’hui parce que tout le monde peut simuler l’authenticité. La question n’est plus de savoir si vous êtes capable de créer du contenu, mais de savoir si vous êtes le seul à pouvoir le faire. Et cela va devenir la nouvelle condition à remplir. »

Privilégier des images explicitement non retouchées et peu flatteuses

Adam Mosseri note aussi que, dans le même temps, les appareils photo des téléphones proposent de plus en plus de fonctionnalités et de filtres logiciels permettant à de simples amateurs de pouvoir partager des contenus de qualité quasi professionnelle.

Le patron d’Instagram estime à ce titre que leurs fabricants font de mauvais choix esthétiques et « romantisent le passé » : « Ils rivalisent pour donner à tout le monde l’air d’un photographe professionnel d’autrefois », permettant à tout un chacun de réaliser des photographies tendant vers la perfection, mais qui ne pourront pas longtemps rivaliser avec les IA.

Ces dernières parviennent en effet désormais à générer des images tellement « parfaites » qu’il devient impossible de les identifier comme synthétiques à l’œil nu. Dès lors, ce n’est plus la perfection qu’il faut chercher, mais l’imperfection, avance Adam Mosseri :

« On va assister à une nette accélération de la tendance vers une esthétique plus brute dans les prochaines années. Les créateurs avisés vont privilégier des images d’eux-mêmes explicitement non retouchées et peu flatteuses. Dans un monde où tout peut être parfait, l’imperfection devient un signal. Le caractère brut [« rawness », en VO] n’est plus seulement une préférence esthétique : c’est une preuve. C’est une forme de défense. Une façon de dire : c’est authentique parce que c’est imparfait. »

De la quête de perfection à celle de l’imperfection

Patron d’une entreprise dont le modèle économique repose sur le partage de selfies et de photos retouchées au moyen de filtres logiciels, cet abandon de la quête de perfection pour celle de l’imperfection ressemble à une révolution quasi-copernicienne :

« Pendant la majeure partie de ma vie, j’ai pu supposer sans risque que la grande majorité des photos ou des vidéos que je voyais étaient des captures fidèles de moments qui s’étaient réellement produits dans la vie réelle. Ce n’est clairement plus le cas aujourd’hui, et il nous faudra, en tant qu’êtres humains, des années pour nous y adapter. […] Cela va être extrêmement inconfortable pour nous tous, car nous sommes génétiquement prédisposés à croire ce que nous voyons. »

Ce changement de paradigme fera qu’ « au fil du temps, nous allons passer d’une attitude consistant à supposer que ce que nous voyons est réel par défaut à une attitude sceptique lorsque nous consultons les médias, et nous allons accorder beaucoup plus d’attention à ceux qui partagent quelque chose et aux raisons pour lesquelles ils le font ».

Les plateformes de réseaux sociaux vont dès lors subir une pression croissante pour identifier et signaler les contenus générés par l’IA. Le patron d’Instagram ne le précise pas, mais l’article 50 de l’AI Act rendra cette labellisation des contenus GenAI obligatoire à compter du mois d’août 2026.

« Toutes les grandes plateformes feront du bon travail pour identifier les contenus générés par l’IA, mais elles auront de plus en plus de mal à le faire à mesure que l’IA s’améliorera dans l’imitation de la réalité », relève toutefois Adam Mosseri :

« De plus en plus de personnes pensent, comme moi, qu’il sera plus pratique d’identifier les médias authentiques que les faux. Les fabricants d’appareils photo pourraient signer cryptographiquement les images au moment de la capture, créant ainsi une chaîne de contrôle. »

Instagram devra « clairement identifier les contenus générés par l’IA »

Il souligne cependant que le fait d’ « indiquer si un contenu est authentique ou généré par l’IA n’est qu’une partie de la solution ». Les plateformes et acteurs du marché de l’économie de l’attention devront également « fournir beaucoup plus d’informations contextuelles », non seulement sur les médias mais aussi sur les comptes qui les partagent, « afin que les utilisateurs puissent prendre des décisions éclairées sur ce qu’ils doivent croire » :

« Où se trouve le compte ? Quand a-t-il été créé ? Quels autres contenus a-t-il publiés ? Dans un monde où l’abondance et le doute sont infinis, les créateurs qui parviennent à maintenir la confiance et à afficher leur authenticité, en étant sincères, transparents et cohérents, se démarqueront. »

Évoquant le cas particulier d’Instagram, Adam Mosseri explique que ses équipes vont devoir « évoluer de plusieurs façons, et rapidement ». À commencer par le fait de créer les meilleurs outils, « basés sur l’IA ou traditionnels », pour que les créateurs « puissent rivaliser avec les contenus entièrement créés par l’IA ».

Instagram devra aussi « clairement identifier les contenus générés par l’IA » et travailler avec les fabricants pour vérifier leur authenticité « dès leur capture, en identifiant les médias réels, et pas seulement en traquant les faux ». Ainsi que pour « mettre en avant les signaux de crédibilité » concernant les auteurs des publications afin que les utilisateurs puissent décider à qui faire confiance.

Il évoque enfin le fait de « devoir continuer à améliorer le classement en fonction de l’originalité », et propose de revenir sur la question de la transparence et du contrôle des algorithmes dans un autre article.

Commentaires (15)

Abonnez-vous pour prendre part au débat

Déjà abonné ou lecteur ? Se connecter

Cet article est en accès libre, mais il est le produit d'une rédaction qui ne travaille que pour ses lecteurs, sur un média sans pub et sans tracker. Soutenez le journalisme tech de qualité en vous abonnant.

Accédez en illimité aux articles d'un média expert

Profitez d'au moins 1 To de stockage pour vos sauvegardes

Intégrez la communauté et prenez part aux débats

Partagez des articles premium à vos contacts

Abonnez-vousLe 5 janvier à 17h16

Le 5 janvier à 17h26

Le 5 janvier à 17h30

Le 5 janvier à 17h41

On va se mettre à faire des fautes pour ne pas passer pour des IAs. Bon, pour certains ça ne va pas être très difficile.

Le 5 janvier à 18h01

En attendant, personnellement, je continue de ne pas aller dans les égouts, A.K.A. médias sociaux.

Le 5 janvier à 19h31

Le 5 janvier à 19h58

Le 5 janvier à 22h42

D'autant que sur les réseaux sociaux, on a déjà un paquet d'automatisation (bots) qui vient (re)publier du contenu tiré d'autres plateformes avec une forme d'auto-alimentation de reposts réguliers.

Pas besoin de l'IA pour ça. Mais l'overdose d'IA peut faire arrêter cette consommation.

Peut-être assiste-t-on à la mort de cette forme d'internet, le web 2.0 et les réseaux sociaux ?

Si seulement ça pouvait permettre de revenir à une publication plus "normale" (le retour à la douce époque des sites de blogs et des forums

Mais

1/ c'est tout un écosystème qui porte des milliards (GAFAM) qui va s'effrondrer dans cette possible mort.

ça va impacter énormément les bourses et donc l'économie réelle.

2/ se réinventer, revenir à plus d'authenticité ... => c'est surtout "prouver que l'on est humain".

Et donc c'est + de flicage/autoritarisme/...

Peut-être est-ce nécessaire ?

Je ne sais pas, mais vu tout le passif déjà de ces volontés de contrôler, on voit bien où ça va emmener et ça je n'en veux pas.

Peu importe ce qui arrive, on n'en sortira pas grandis.

Modifié le 5 janvier à 23h21

Premier signe concret ces derniers jours puisque il parait que le bar nazi a enfin quitté la liste des 50 marques les plus bankables.

Le 6 janvier à 03h02

Le 6 janvier à 06h41

Après je vois déjà des difficultés pour des retouches non IA qui casserait la crypto de la photo (recadrage, luminosité, contraste, etc). Il faudrait alors que ça soit fait sur l'appli pour qu'elle signe elle-même la photo.

Et les remarques générales ne sont pas bêtes non plus. Merci pour l'article !

Le 6 janvier à 07h43

Cela arrangerait bien les fournisseurs d'IA que l'on puisse certifier les contenus sans IA. Donc, selon moi, certifier les contenus sans IA intéresse avant tout les sociétés de l'IA et je ne compte pas leur faciliter la tâche.

Le 6 janvier à 09h13

Je me dis naïvement que si le "certificat" est apposé sous forme d'un watermark invisible sur la photo, il risquerait d'être altéré au post-traitement. Ou alors le fichier RAW embarque une sorte de DRM qui rendrait l'interopérabilité hasardeuse (et ils iront se faire foutre pour que je paye une saloperie de chez Adobe, vive Darktable).

Et dans le cas où ce serait de la vulgaire meta donnée, elle pourrait se faire effacer sans difficultés.

Bref, ça m'inquiète sur une énième DRMisation des contenus avec les risques de privation de libertés quant au choix de sa solution de travail.

Le 6 janvier à 10h23

Forme canonique a prendre dans le sens preuve reconstructible comme en cryptologie, branches intégrité et signature.

Avec cette forme canonique normalisée, Instagram peut reconstruire le résultat final et valider que c'est bien parti d'un travail humain.

A priori, ce ne serait pas une DRMisation. Mais cela va imposer des outils compatibles qui génèrent aussi la forme canonique.

Et selon le processus de vérification, s'il est par reconstruction à l'identique le choix des outils sera limité, s'il est par reconstruction partielle et comparaison d'une étape à l'autre il restera plus de liberté au créateur.

Comme c'est lui, le patron d'Instagram, qui paye les créateurs, il pourrait l'imposer à ces derniers, et nous simples utilisateurs n'aurions que le résultat final et une validation que c'est très probablement humain par Instagram.

Quand à Instagram, il aurait tout. C'est "normal" qu'en tant que patron d'Instagram, il prospecte dans cette direction. C'est tout aussi normal que des utilisateurs et/ou créateurs comme toi, s'interrogent.

Le 6 janvier à 09h33

Signaler un commentaire

Voulez-vous vraiment signaler ce commentaire ?