Les AI Overviews de Google fournissent aussi des conseils de santé erronés

Aïe aïe AI Overviews

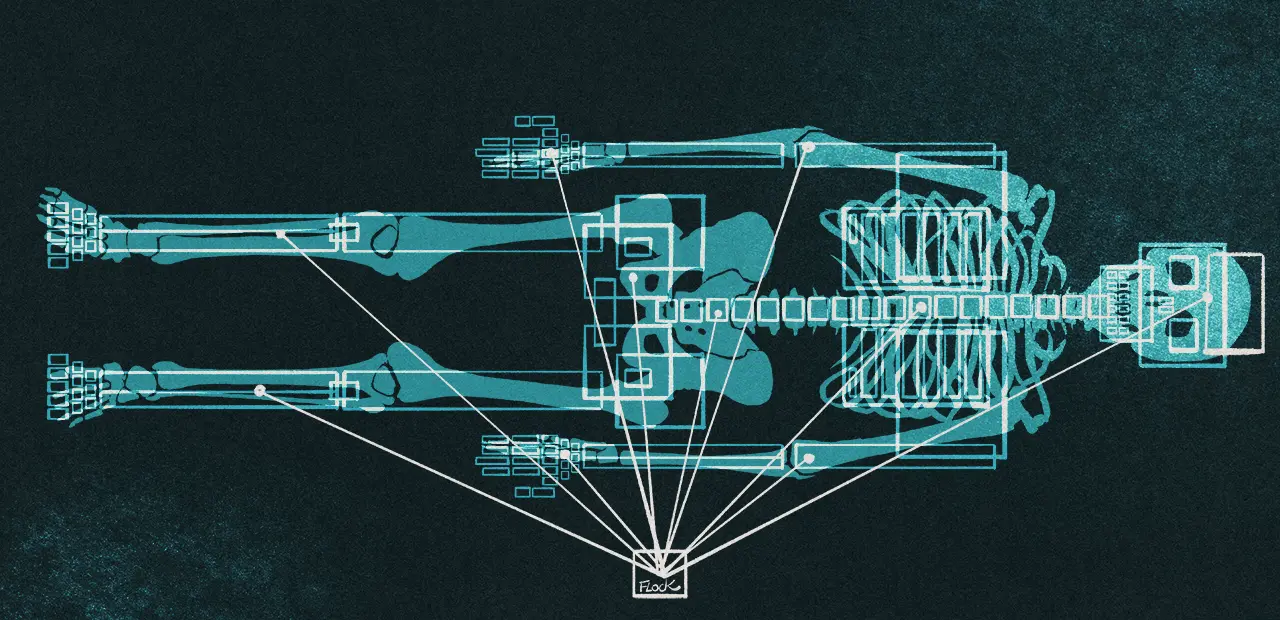

Illustration : Flock

Le 05 janvier à 15h37

Alerté par des professionnels de santé, The Guardian a découvert que les synthèses générées par IA (« AI Overviews ») figurant en tête des résultats du moteur de recherche fournissaient parfois des informations médicales « fausses et trompeuses ». Mais également qu’il leur arrivait de fluctuer en fonction du moment.

Les AI Overviews de Google fournissent aussi des conseils de santé erronés

Aïe aïe AI Overviews

Illustration : Flock

Alerté par des professionnels de santé, The Guardian a découvert que les synthèses générées par IA (« AI Overviews ») figurant en tête des résultats du moteur de recherche fournissaient parfois des informations médicales « fausses et trompeuses ». Mais également qu’il leur arrivait de fluctuer en fonction du moment.

IA et algorithmes

IA

5 min

Google avance que ses « AI overviews », qui proposent en tête des résultats de recherche des « aperçus » résumant les réponses identifiées par l’IA générative comme les plus pertinentes, sont « utiles » et « fiables ».

Alerté par plusieurs professionnels de santé, le Guardian a découvert, a contrario, qu’ils exposent leurs utilisateurs « à des risques de préjudice en raison de conseils [et] d’informations médicales fausses et trompeuses ».

Dans un cas qualifié de « très dangereux » par les experts interrogés par le Guardian, Google a par exemple conseillé à tort aux personnes atteintes d’un cancer du pancréas d’éviter les aliments riches en graisses. Ce qui va à l’encontre des recommandations habituelles et pourrait augmenter le risque de décès des patients, soulignent les experts.

Cela « pourrait être très dangereux et compromettre les chances d’une personne d’être en assez bonne santé pour suivre un traitement », explique Anna Jewell, directrice du soutien, de la recherche et de la sensibilisation chez Pancreatic Cancer UK, pour qui la réponse générée par IA est « totalement incorrecte » :

« La réponse de l’IA de Google suggère aux personnes atteintes d’un cancer du pancréas d’éviter les aliments riches en graisses et fournit une liste d’exemples. Cependant, si quelqu’un suivait les conseils donnés dans les résultats de recherche, il risquerait de ne pas absorber suffisamment de calories, d’avoir du mal à prendre du poids et d’être incapable de tolérer la chimiothérapie ou une intervention chirurgicale potentiellement vitale. »

Dans un autre exemple à propos de problèmes hépatiques qualifié cette fois d’ « alarmant », le moteur de recherche a là encore fourni des informations erronées, offrant peu de contexte et aucune prise en compte de la nationalité, du sexe, de l’origine ethnique ou de l’âge des patients, souligne le Guardian. Pis : elles pouvaient amener des personnes atteintes d’une maladie grave du foie à estimer, à tort, qu’elles seraient en bonne santé.

« De nombreuses personnes atteintes d’une maladie du foie ne présentent aucun symptôme jusqu’aux stades avancés, c’est pourquoi il est si important qu’elles se fassent dépister », explique au Guardian Pamela Healy, directrice générale du British Liver Trust :

« Mais ce que l’IA de Google considère comme « normal » peut varier considérablement de ce qui est réellement considéré comme normal. C’est dangereux, car cela signifie que certaines personnes atteintes d’une maladie hépatique grave peuvent penser que leurs résultats sont normaux et ne pas se donner la peine de se rendre à un rendez-vous médical de suivi. »

Des synthèses générées par IA qui changent selon le moment

Une recherche Google sur les « symptômes et tests du cancer du vagin » a répertorié le frottis du col de l’utérus comme un test de dépistage du cancer du vagin, ce qui est là encore « totalement erroné » et pourrait amener à ignorer des symptômes avérés, souligne Athena Lamnisos, directrice générale de l’association caritative Eve Appeal :

« Obtenir des informations erronées comme celle-ci pourrait potentiellement conduire une personne à ne pas faire examiner ses symptômes de cancer du vagin parce qu’elle a obtenu un résultat normal lors d’un dépistage cervical récent. »

Elle se dit également « extrêmement préoccupée » par le fait que le résumé généré par l’IA changeait au fil du temps, « donnant à chaque fois une réponse différente provenant de sources différentes lorsque nous effectuions exactement la même recherche » :

« Cela signifie que les gens obtiennent une réponse différente selon le moment où ils effectuent leur recherche, ce qui n’est pas acceptable. Certains des résultats que nous avons vus sont vraiment inquiétants et peuvent potentiellement mettre les femmes en danger. »

Le Guardian a également constaté que les aperçus fournis par l’IA de Google en réponse à des recherches sur des troubles mentaux tels que la psychose et les troubles alimentaires offraient des « conseils très dangereux » et étaient « incorrects, nuisibles ou susceptibles d’inciter les gens à ne pas demander d’aide », explique Stephen Buckley, responsable de l’information chez Mind, qui les qualifie de « très préoccupants » :

« Elles peuvent suggérer d’accéder à des informations provenant de sites inappropriés… et nous savons que lorsque l’IA synthétise des informations, elle peut souvent refléter des préjugés, des stéréotypes ou des discours stigmatisants existants. »

Des « captures d’écran incomplètes », plaide Google

Google a répondu au Guardian que la « grande majorité » de ses AI Overviews étaient « factuels et utiles », et qu’elle apportait continuellement des améliorations à leur qualité. Le taux de précision des aperçus IA serait « comparable » à celui de ses autres fonctionnalités de recherche, telles que les extraits optimisés, qui existent depuis plus d’une décennie, a-t-elle précisé.

Un porte-parole de Google a répondu au Guardian que bon nombre des exemples liés à la santé qui leur avaient été communiqués étaient des « captures d’écran incomplètes », rajoutant que d’après ce qu’ils avaient pu évaluer, les réponses renvoyaient « vers des sources connues et réputées, et recommandaient de consulter un expert » :

« Nous investissons considérablement dans la qualité des AI Overviews, en particulier pour des sujets tels que la santé, et la grande majorité d’entre eux fournissent des informations exactes. »

Commentaires (2)

Abonnez-vous pour prendre part au débat

Déjà abonné ou lecteur ? Se connecter

Cet article est en accès libre, mais il est le produit d'une rédaction qui ne travaille que pour ses lecteurs, sur un média sans pub et sans tracker. Soutenez le journalisme tech de qualité en vous abonnant.

Accédez en illimité aux articles d'un média expert

Profitez d'au moins 1 To de stockage pour vos sauvegardes

Intégrez la communauté et prenez part aux débats

Partagez des articles premium à vos contacts

Abonnez-vousLe 5 janvier à 15h55

Le 5 janvier à 16h56

Signaler un commentaire

Voulez-vous vraiment signaler ce commentaire ?