Élections européennes : Meta échoue à modérer des publicités de propagande pro-russe

Doppelgänger toujours actif

[Exclusivité Next] Une nouvelle étude d’AI Forensics illustre la faiblesse de la modération des publicités politiques réalisée par Meta, et la manière dont des réseaux d’influence pro-russe en tirent profit.

Le 17 avril 2024 à 08h01

7 min

Société numérique

Société

Alors qu’en France, VIGINUM a alerté Raphaël Glucksman (tête de liste PS-Place Publique) qu’il était visé par une campagne de désinformations menée par des acteurs pro-chinois, c’est une autre opération, d’obédience pro-russe, contre laquelle alerte AI Forensics.

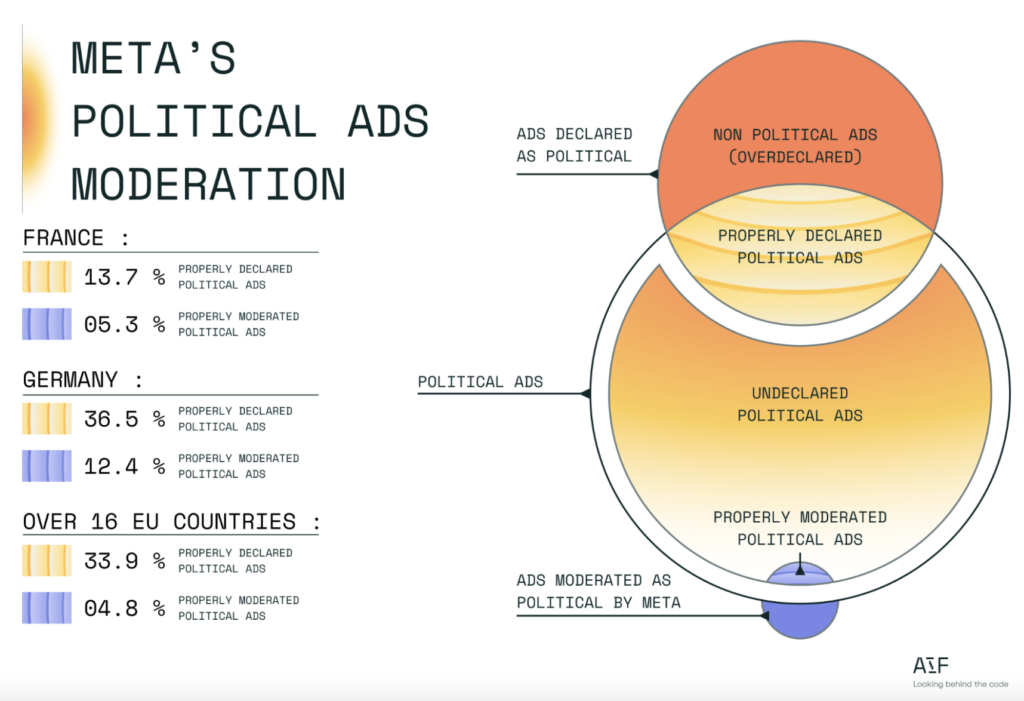

Dans une étude publiée ce 17 avril, l’ONG estime qu'au moins 60 % des publicités politiques diffusées sur Facebook et Instagram ne sont pas déclarées comme telles (contrairement aux règles de Meta).

Parmi elles, l’entreprise n’en modère que 5 %, même si certaines publicités sont ouvertement politiques (par exemple en France, seulement 16,3 % des 293 publicités contenant le nom du Président Macron ont été modérées).

Par ailleurs, quand la modération a lieu, dans 60 % des cas, elle opère de manière incohérente avec les règles de Meta – ce qui peut participer à compliquer la tâche des diffuseurs.

À l’approche des élections parlementaires européennes, cela crée des problématiques très concrètes dans la mesure où la France et l’Allemagne sont largement visées par une campagne de publicités pro-russes.

Au moins 3 800 pages jouent ainsi de l’actualité (manifestations d’agriculteurs, aide humanitaire) « pour saper le soutien à l’Ukraine et le soutien institutionnel à l’Union Européenne ». AI Forensics estime que ces pages ont touché plus de 38 millions de comptes entre août 2023 et mars 2024.

L’ONG constate par ailleurs qu’un réseau coordonné de pages inonde Facebook, Instagram et Messenger d’arnaques aux faux investissements, dans une campagne qui a touché au moins 128 millions de comptes dans dix pays de l’Union européenne pendant les seuls mois de janvier et février 2024.

La bibliothèque publicitaire de Meta : incomplète, mais l’une des plus utilisables

Pour réaliser son étude, AI Forensics s’est penchée sur les publications recensées dans la bibliothèque de publicité Meta Ad Library à travers 16 pays entre le 17 août 2023 – quand l’outil a été étendu pour répondre aux obligations du Digital Services Act (DSA, règlement sur les services numériques) – et le 29 février 2024. Ce faisant, elle a constitué un jeu de 200 millions de publicités publiées dans ces pays depuis huit mois.

« Alors que Meta prétend prendre en compte le texte, les images, les vidéos et les liens pour la modération des publicités », les auteurs précisent n'avoir « eu accès qu'au texte des publicités par l'intermédiaire de l’API ». Ils ont par ailleurs filtré les annonces les plus courtes (« short ads ») et « se sont concentrés sur les langues les plus utilisées, qui représentent plus de 90 % des publicités de l’Union européenne ».

AI Forensics précise que son travail a été rendu possible par la rapide mise en conformité de Meta avec les nouvelles règles européennes. « Les outils équivalents déployés par d’autres plateformes, en particulier X, Snapchat et Bing, n’ont pas mis les données publicitaires à disposition dans la même mesure. »

Le 16 avril, un rapport de la Fondation Mozilla allait dans le même sens, soulignant d’importants manquements de la part des onze acteurs soumis à des obligations spécifiques de transparence par le Digital Services Act à l’approche de l’échéance électorale européenne.

Fondée en mai 2023 pour prendre la suite de l’entité « Tracking Exposed », AI Forensics s’est donnée pour mission d’être les « détectives numériques » qui « détectent les injustices algorithmiques cachées ». Autrement dit, l’ONG met au point des méthodologies qui lui permettent d'analyser les effets réels des algorithmes qui influent sur les décisions des internautes.

Pour la présente étude, AI Forensics a entraîné un modèle de langage à prédire si une publicité tombait ou non dans la définition des publicités politiques telles que définies par Meta, analyse à laquelle elle a ajouté l’annotation manuelle de 100 publicités modérées par Meta et 100 publicités déclarées politiques par leurs auteurs.

Elle a aussi cherché des traces de campagnes coordonnées, c’est-à-dire de même publicité (ou des contenus très proches) soumis à de multiples reprises par de multiples publicitaires, sans que la nature politique des publications ne soit soulignée aux plateformes de Meta. Pour ce faire, AI Forensics s’est inspiré des méthodes de Viginum.

Un réseau connu d’influenceurs pro-russe et des arnaques financières

AI Forensics constate qu’une large part des manœuvres d’influence pro-russe relèvent du réseau « Doppelgänger ». Celui-ci avait déjà été épinglé en 2022 par EUDisinfoLab, puis par DFRLab et Sentinel Labs en 2024.

Meta a déclaré avoir démantelé le réseau en 2022, puis l’a qualifié d’ « opération de désinformation la plus grande et la plus persistante » en 2023, mais AI Forensics constate à son tour que celui-ci est toujours actif.

Surtout, l’ONG observe que Doppelgänger a une portée 5 à 10 fois plus élevée que ce qui était rapporté jusque-là, avec 38 millions de comptes touchés par ses activités en France et en Allemagne entre août et février.

Parmi les messages publiés, en septembre, certains accusaient les États-Unis d’avoir participé au conflit opposant l’Ukraine et la Russie pour augmenter ses ventes d’armes. En octobre, des publications accusaient le président ukrainien d’avoir utilisé des armes de l’armée ukrainienne pour des motifs personnels, voire déclaraient que ces armes avaient été utilisées dans l’attaque du Hamas contre Israël. En novembre, après la décision du gouvernement allemand de fournir une aide supplémentaire à Kyiv, des publicités ont été lancées pour critiquer le soutien allemand à l’Ukraine. En janvier, des publicités se sont focalisées sur les manifestations d’agriculteurs pour militer en défaveur de l’intégration de l’Ukraine à l’Union européenne, etc.

En effet, l’ONG a aussi relevé des investissements transfrontaliers coordonnés dans des campagnes de publicités pour de faux investissements, notamment dans le domaine des crypto-actifs. Ces publicités ont touché 120 millions de comptes utilisateurs pendant les seuls mois de janvier et de février 2024.

Les élections européennes sont un premier test « critique » pour le Digital Services Act, qui fournit à l’Union européenne les outils pour réagir, écrit AI Forensics. Et de recommander à la Commission Européenne de lancer une procédure d’infraction à l’encontre de Meta en vertu des articles 34 et 35 du règlement, qui obligent l’entreprise à atténuer les risques systémiques posés par ses plateformes.

Elle appelle aussi à obliger les autres VLOP (très grandes plateformes numériques) à créer des bibliothèques publicitaires complètes et réellement utilisables.

Élections européennes : Meta échoue à modérer des publicités de propagande pro-russe

-

La bibliothèque publicitaire de Meta : incomplète, mais l’une des plus utilisables

-

Un réseau connu d’influenceurs pro-russe et des arnaques financières

Commentaires (22)

Le 17/04/2024 à 10h00

Modifié le 17/04/2024 à 10h16

Je m'étonnes que les États ne demandent pas plus de contrôles sur la manière dont Meta (ou tout autre réseau social) censure.

Au delà de tout aspect technique, il me parait plus essentiel que les États aient un droit de regard sur l'implémentation des règles de filtrages dictées par leur Loi.

Le 17/04/2024 à 10h24

Le 17/04/2024 à 10h57

C'est en cela qu'on peut passer entre les mailles du filet.

D'où le droit de regard sur l'implémentation des règles de filtrages.

Le 19/04/2024 à 09h22

C'est ça qui me dérange : Meta n'est-il pas ainsi responsable de ce qu'il diffuse ?

Le 19/04/2024 à 17h53

Meta n'est-il pas ainsi responsable de ce qu'il diffuse ?

Meta ne publie pas les contenus, ce sont les utilisateurs des réseaux sociaux qui décident de publier tel ou tel contenu.

Meta ne fournit que la plateforme.

En ce sens, Meta ne peut être tenu responsable des contenus publiés par autrui.

Mais Meta doit respecter les lois et notamment les notifications de suppression/blocage de contenus illicites (au sens de la loi) qui lui auront été signalés.

Si on considère que Meta, en temps que fournisseur de plateforme, est responsable de tous les contenus alors on peut également rendre responsable les fournisseurs d'internet responsables, mais également les hébergeurs de sites web ou encore les outils de publication comme Wordpress.

Et c'est clairement une porte à ne surtout pas ouvrir, si on veut conserver un minimum de liberté d'expression.

Dans le cas contraire, c'est un monde à la 1984 qui s'offrira à nous...

Le 19/04/2024 à 18h09

Il est bien sûr impossible de limiter l'accès aux utilisateurs, mais c'est plus faisable pour un annonceur.

Le 19/04/2024 à 18h51

Le 17/04/2024 à 10h58

Le 17/04/2024 à 11h27

Modifié le 17/04/2024 à 19h37

Le 17/04/2024 à 15h30

Sur la "bien pensance", l'ironie du commentaire m'échappe moins.

Un article n'est jamais malvenu, dans l'absolu.

Soit il raconte des choses avérées, soit il raconte (au moins partiellement) des carabistouilles.

Dans ce dernier cas, vous êtes tout à fait libres de proposer des analyses contradictoires, faits à l'appui.

Ce site n'est pas avare de commentateurs passionnés, je suis certain qu'une contre analyse correctement documentée sera largement discutée.

Critiquer l'article en le taxant de "politique" sans rien développer de son point de vue contradictoire, c'est un peu l'hôpital qui se fout de la charité, IMHO.

Le 17/04/2024 à 21h43

Le 17/04/2024 à 21h59

Je suis assez content de ce choix, ça me paraît être un meilleur compromis qu’avant.

Le 17/04/2024 à 16h28

Le 17/04/2024 à 17h16

Ca plus les dizaines de TB de messages, je vais finir par facturer, je ne déconne pas.

Le 17/04/2024 à 20h04

Personnellement, je pense que l'IA peut apporter de bonnes choses quand elle est bien utilisée.

Je peux prouver ce que je dis sur ce que l'on lit ici sur l'IA. Voici quelques exemples :

On parle d'hallucination ici ou là.

Le plagia a été évoqué ici et là.

La qualité des articles est abordée ici et là.

La désinformation : ici.

Pour le biais, c'est ici.

Et enfin, voici pour une consommation trop forte d'énergie qui est évidement mauvais pour la planète.

Le 17/04/2024 à 21h48

Par exemple un simple algorithme de pré traitement d'informations effectué à partir de requêtes/règles extrêmement simples sera qualifié d'IA au même titre qu'une IA dite générative.

Le 18/04/2024 à 00h51

Parce que je n'ai pas seulement lu "IA" dans le nom de l'ONG, j'ai aussi lu leur rapport.

Modifié le 18/04/2024 à 01h26

Bien sur qu'il y a des erreurs comme dans toute modélisation. C'est même marqué dans le rapport: ils utilisent le "F1 Score" qui donne 88% de bonnes prévisions et donc 12% d'erreurs potentielles.

Ensuite quand la sortie donne un échantillon réduit, ils vérifient manuellement la véracité de ces pubs (pour éviter les faux positifs).

Dans tous les cas, la méthode a été faite pour minimiser les erreurs de Méta.

Le 18/04/2024 à 17h46

Le iii) parce que des pubs avec le nom Macron) ne sont pas forcément politiques et le iv) "ads moderated by Meta as political" parce qu'il ressort de leur étude Meta modère très peu les annonces politiques qui ne sont pas déclarées comme telles (donc, on ne peut pas faire confiance à cet échantillon pour entraîner le modèle).

Ils ont aussi annoté 3000 pubs manuellement pour 14 langues, mais en fait, ça fait assez peu par langue (214). À comparer aux 240 millions de pubs sur Meta pour la période sur laquelle porte leur étude.

Après, je pense que leur étude est intéressante et probablement assez proche de la vérité mais qu'il faudrait qu'elle soit vérifiée par des chercheurs.

Le 21/04/2024 à 20h21

George Orwell