Un logiciel de reconnaissance faciale identifie un afro-américain à partir d’une vieille photo

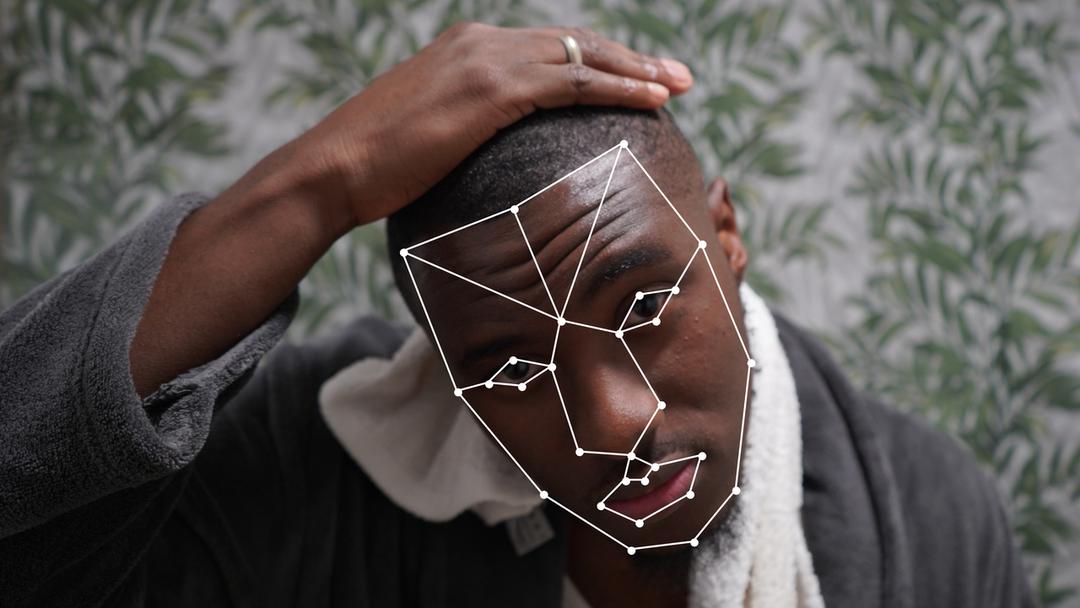

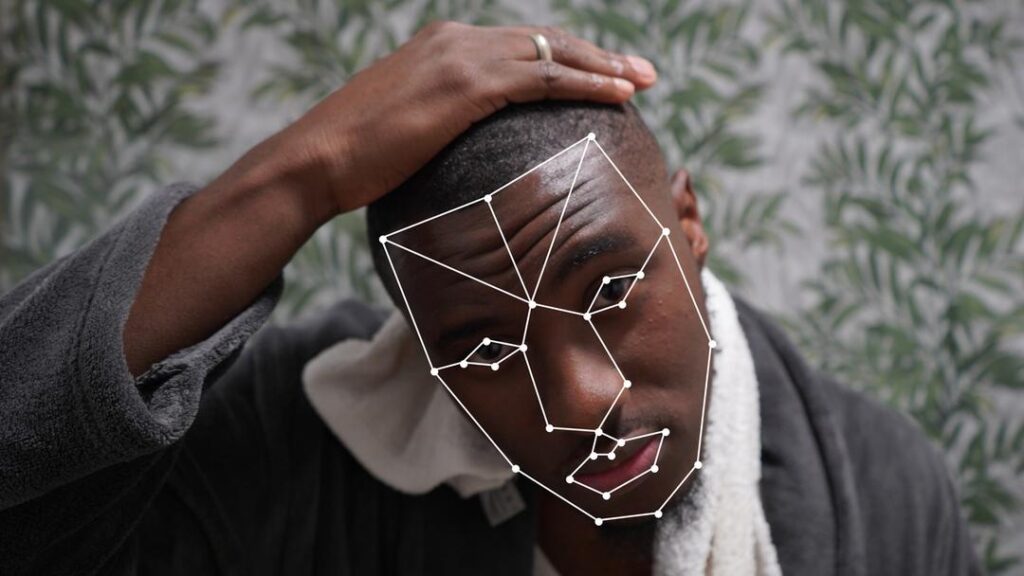

Mirror B – Comuzi – Better Images of AI

2 min

Droit

Droit

Un Afro-Américain de 39 ans vient d’être incarcéré pour un meurtre commis en 2012, rapporte le Daily Mail. Il a été confondu grâce à un logiciel de reconnaissance faciale à partir d’une photo prise par un téléphone portable cette année-là.

En 2012, un Afro-Américain de 34 ans, Julio Torres, était abattu en Pennsylvanie après une altercation avec deux autres Afro-Américains. Des images de vidéosurveillance indiquaient qu’ils avaient bu dans des gobelets en polystyrène.

Leur analyse génétique permettait l’identification de l’un des deux suspects, dont l’ADN figurait dans une base de données policière. Il a été condamné à cinq ans de prison en 2013 après que les policiers ont déterminé que ce n’était pas lui qui avait tiré.

L’identité du meurtrier, dont l’ADN n’avait pas été préalablement fiché, n’avait pu être confondue, jusqu’à ce qu’une unité « cold case » ne rouvre l’affaire l’an passé.

Les enquêteurs ont en effet récupéré une photo du tireur présumé prise à l’époque avec un téléphone portable lors d’une fête quelque temps avant l’homicide. Un logiciel de reconnaissance faciale leur a indiqué l’identité d’un suspect potentiel.

Ce dernier, Vallis L. Slaughter, 39 ans, placé sous surveillance, avait l’habitude de fumer sur le trottoir devant le logement de sa mère, chez qui il vivait, et de jeter les mégots par terre. L’analyse génétique de l’un de ses mégots a confirmé que l’ADN prélevé sur le gobelet en 2012 était bien le sien.

Jusqu’alors, l’utilisation policière de la reconnaissance faciale biométrique s’était surtout illustrée, aux États-Unis, pour avoir identifié, à tort, des Afro-Américains innocents de ce dont ils furent pourtant accusés.

- Accusée à tort par un algorithme de reconnaissance faciale

- Aux États-Unis, six jours de prison pour cause de reconnaissance faciale erronée

Il est en effet notoire, depuis la publication de l’étude Gender Shades par la chercheuse Joy Buolamwini en 2018, que plus la peau d’un sujet est foncée, moins les algorithmes de reconnaissance faciale fonctionnent correctement.

L’identification de Vallis L.Slaughter semble montrer, a contrario, qu’elle peut aussi s’avérer efficace, même à partir d’une photo de mauvaise qualité.

Commentaires (14)

Abonnez-vous pour prendre part au débat

Déjà abonné ou lecteur ? Se connecter

Cet article est en accès libre, mais il est le produit d'une rédaction qui ne travaille que pour ses lecteurs, sur un média sans pub et sans tracker. Soutenez le journalisme tech de qualité en vous abonnant.

Accédez en illimité aux articles d'un média expert

Profitez d'au moins 1 To de stockage pour vos sauvegardes

Intégrez la communauté et prenez part aux débats

Partagez des articles premium à vos contacts

Abonnez-vousLe 29/03/2024 à 08h46

En tout cas, on voit bien que l'efficacité du procédé pour retrouver une personne n'est plus à démontrer, tant que ça ne sert pas de preuve en soit comme ici où l'ADN a parlé.

Le 29/03/2024 à 17h05

Le 29/03/2024 à 09h56

C'est étrange, j'ai pourtant lu récemment que l'ADN n'était pas une preuve.

("Si on ne peut confirmer, avec une certitude absolue, l’identité entre deux profils comparés, il est par contre possible de réfuter avec certitude qu'une trace prélevée sur une scène de crime correspond au profil génétique d'un suspect"

source

source de Next: https://www.police-nationale.interieur.gouv.fr/nous-decouvrir/notre-organisation/organisation/service-national-de-police-scientifique-snps

Le 30/03/2024 à 11h48

Le 29/03/2024 à 10h09

Est-ce parce qu'il a été fiché depuis par la police (tant pis pour lui), est-ce une photo liée à une pièce d'identité (fichier des gens honnêtes) ou enfin est-ce Clearview (ce cancer de la vie privée) qui l'a identifié grâce à des photos de lui récupérées sur le Web ?

Il n'y a rien à ce sujet dans l'article d'origine.

Et en cherchant ailleurs, je n'ai rien trouvé non plus. Par contre la plupart des sites qui parlent de l'affaire titrent sur l'ADN ou la cigarette et pas sur la reconnaissance faciale.

Le 30/03/2024 à 11h51

Et j'ai titré sur la reconnaissance faciale parce qu'on avait jusqu'alors surtout écrit au sujet des Afro-Américains identifiés "à tort" d'une part, d'autre part au vu de la résolution de la photo ; l'ADN n'a fait que confirmer, dans un second temps, l'identité du meurtrier.

Le 29/03/2024 à 10h41

Le 29/03/2024 à 11h54

Modifié le 29/03/2024 à 12h40

Le 29/03/2024 à 12h09

Modifié le 29/03/2024 à 21h49

Le 30/03/2024 à 11h01

Deux opposants énumèrent les problèmes d'une techno (ici surveillance), l'un fait croire qu'il y a 0 avantages, l'autre tempère le propos en citant les quelques avantages.

Qui penses-tu que les gens à convaincre (qui pensent/savent qu'il y a un intérêt à la techno) vont écouter ?

Le 30/03/2024 à 12h03

Le 01/04/2024 à 11h20

Le problème il me semble c'est que plus la base est grande (ex fichier des gens honnêtes) plus les probabilité doivent être bonnes pour ne pas sélectionner à tort de très nombreuses personnes. Si on cherche une personne sur une base de 45 millions, un taux de 99,9 % équivaut déjà à 44 999 faux positifs !

Signaler un commentaire

Voulez-vous vraiment signaler ce commentaire ?