La Quadrature réitère son appel à l’interdiction des logiciels de police prédictive

Rapport aux minorités

Adriano Balbi et André-Michel Guerry, via LQDN

L'ONG déplore que les logiciels de police prédictive « mobilisent des données biaisées, s’appuient sur des théories criminologiques dangereuses, et en tant que tels menacent les libertés publiques et les droits humains ».

Le 24 janvier à 15h09

14 min

Droit

Droit

En 2020, la Quadrature du Net avait déjà qualifié les logiciels de police prédictive de dispositifs « dangereux et à l'efficacité douteuse ». Dans un billet publié sur son projet Technopolice, l'association appelait à leur interdiction, soulignant que plusieurs villes en étaient déjà équipées : Montpellier, l’agglomération Hérault Méditerranée, Lyon, Lille, Montauban, Villeurbanne, Angers, Colombes…

La semaine passée, « après plusieurs mois d’enquête » et dans le cadre d’une initiative européenne coordonnée par l’ONG britannique Fair Trials, elle a publié un nouveau rapport sur l’état de la police prédictive en France.

Elle y compile et analyse les informations accessibles sur plusieurs logiciels de police prédictive anciennement ou actuellement en utilisation au sein des forces de police françaises, et notamment :

- RTM (Risk Terrain Modelling), un logiciel de « prévention situationnelle » utilisé par la préfecture de Police de Paris pour cibler les zones d’intervention à partir des données « environnementales » (présence d’écoles, de commerces, de stations de métro, etc.) ;

- PredVol, logiciel développé en 2015 au sein d’Etalab, expérimenté en Val d’Oise en 2016 pour évaluer le risque de vols de véhicule, abandonné en 2017 ou 2018, des agents ayant utilisé le logiciel l'ayant qualifié d' « expérimentation ridicule », de « résultats dénués de sens et de scientificité », et d’« expérience qui fait mal » ;

- PAVED, acronyme de « Plateforme d’analyse et de visualisation évolutive de la délinquance » et logiciel développé à partir de 2017 par le colonel Patrick Perrot, aujourd’hui coordonnateur pour l’intelligence artificielle au sein de la gendarmerie et conseiller « intelligence artificielle » du Comcyber du ministère de l’Intérieur. Expérimenté à partir de 2018 dans 11 départements pour évaluer le risque de vols de voiture ou de cambriolages, le projet a été mis « en pause » en 2019, peu avant sa généralisation prévue sur tout le territoire ;

- M-Pulse, auparavant nommé Big Data de la Tranquillité Publique, développé par la ville de Marseille en partenariat avec la société Engie pour évaluer l’adéquation des déploiements de la police municipale dans l’espace public urbain, et disponible publiquement, dépouillée de toute dimension sécuritaire, policière ou prédictive dans sa version « allégée » des fonctions policières ;

- Smart Police, logiciel créé pour simplifier le travail des policiers et comportant notamment un module « prédictif » mis au point par la startup française Edicia qui, d’après son site web, a vendu cette suite logicielle à plus de 350 forces municipales.

La « statistique morale », discipline à l’origine de la criminologie

L'ONG commence par relever que « la police française peut prétendre au statut de pionnière en matière de police prédictive ». Dès 1829, un jeune statisticien et juriste du ministère de la Justice, André-Michel Guerry, commença en effet à compiler les données sur les crimes à Paris.

Une démarche qui s’inscrivait dans le cadre du premier système national au monde centralisant les données du crime, le « Compte général de l’administration de la justice criminelle en France ».

Ce fichier statistique était basé sur des données collectées tous les trimestres dans chaque département de France et contenant les détails de chaque acte criminel passé devant les juridictions françaises : l’âge, le sexe, le travail de l’accusé, la nature du crime, etc.

Guerry se pencha ensuite sur les « attitudes sociales » qui semblaient, d’après lui, « gouverner le crime ». Il donnera par la suite naissance à ce qu’on appelle la « statistique morale », discipline à l’origine du développement de la criminologie, de la sociologie et des sciences sociales, dont il est considéré aujourd’hui, avec le mathématicien, astronome, naturaliste et statisticien belge Adolphe Quetelet, comme fondateur.

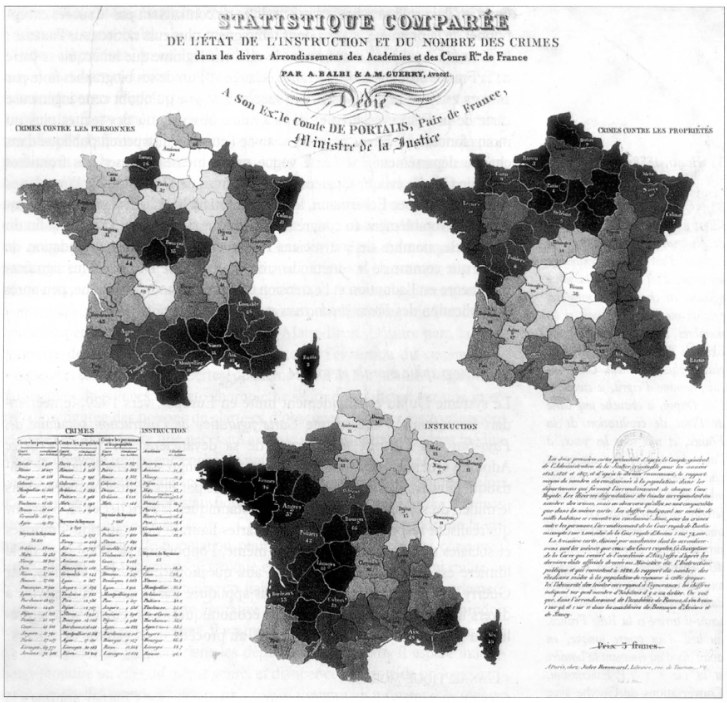

En 1829, Guerry publia, en collaboration avec le géographe vénitien Adriano Balbi, une carte géographique montrant les relations entre le niveau d’instruction de la population française et les violences contre les personnes et crimes à la propriété en France.

Cette carte géographique est aujourd’hui considérée dans le monde comme le premier travail de ce qu’on appellera ensuite en criminologie la « cartographie des crimes », et comme le point de départ de la criminologie prédictive, avec un code couleur du clair au foncé en fonction du taux de criminalité.

Nommé en 1830 directeur des Statistiques Criminelles, un nouveau département du ministère de la Justice, Guerry publie en 1832, alors âgé de 29 ans, un « Essai sur la statistique morale de la France », qui sera considérée comme son œuvre majeure.

Cet essai contenait de nombreuses autres cartes de criminologie montrant des relations entre crimes et variables sociales et morales, à l’image du taux de criminalité et de la richesse, le taux de suicide, les dons aux pauvres, les naissances illégitimes, la répartition par classes d’âge des criminels, etc. Ce travail conduira à sa notoriété croissante à travers l’Europe.

En l’espèce, souligne la Quadrature, « ses résultats montraient l’absence de corrélation statistique entre le niveau d’instruction et la criminalité ».

Un « instrument clé » de la « politique du chiffre »

À partir des années 1990, explique LQDN, alors que les thèses du « nouveau management public » gagnaient l’institution policière, les outils criminologiques expérimentés par les polices étasuniennes, et en particulier la police new-yorkaise sous l’égide de son directeur William Bratton, ont été progressivement intégrés aux pratiques de la police française, en particulier à Paris ou son logiciel COMPSTAT (abréviation de Compare Stats) a été utilisé par les commissaires comme des « instruments de pilotage ».

Or, s'il était d’abord destiné à faire remonter les statistiques sur les faits de délinquance dans le but d’améliorer la réactivité de la police et ses capacités d’anticipation, le logiciel « s’est rapidement mué en instrument clé d’une "politique du chiffre", elle-même partie prenante d’une tentative de légitimation de l’action des bureaucraties policières dans les champs administratifs et politiques », souligne l'ONG.

- Un logiciel pour prédire si quelqu'un est criminel à partir d'une photo de son visage

- Pred-Pol : Los Angeles arrête son programme controversé de « prédiction » de crimes

Les conséquences de cette politique, « largement documentés par les sociologues de la police », ont depuis révélé de nombreux dysfonctionnements. Les policiers de terrain cherchaient en effet à « faire baisser le nombre d’affaires » pour éviter les pressions de la hiérarchie (au point d'aboutir à des refus de prendre les plaintes, au fait de renvoyer un plaignant d’un commissariat à l’autre, au regroupement ou à la requalification des faits constatés).

Ces tripatouillages statistiques entraînaient également et « surtout », souligne LQDN, une concentration de l’activité policière sur les délits les plus « rentables » dans le but de faire remonter le nombre d’affaires « résolues », le tout au détriment de la répression des affaires plus complexes.

Corrélation n’est pas causalité, des données biaisées

La Quadrature déplore que, « par mauvaise foi ou fainéantise idéologique, les développeurs de ces technologies entretiennent une grave confusion entre corrélation et causalité (ou du moins refusent-ils de faire la distinction entre les deux) ».

Et ce, alors que la pertinence des corrélations pour expliquer ou prédire les comportements criminels a été « largement remise en cause par les sociologues et les statisticiens, qui constatent que la criminologie n’est toujours pas en mesure de déterminer de manière concluante les causes de la criminalité ».

- Le fiasco du système de police prédictive de Chicago

- Oakland interdit la police prédictive et la surveillance biométrique

L'ONG constate d'autre part que les scores de risque « sont possiblement corrélés à un taux de chômage ou de pauvreté important », ou encore à « un taux élevé de personnes nées en dehors de l’Union européenne ».

Elle estime dès lors « probable » que, à l’image des algorithmes utilisés par la Caisse nationale des allocations familiales (CNAF), « certaines variables socio-démographiques mobilisées soient discriminatoires », et « risquent de conduire à cibler les populations les plus précarisées et les plus exposées au racisme structurel ».

- Transparence, discriminations : les questions soulevées par l’algorithme de la CAF

- Le code source de la CAF révèle une catégorisation discriminatoire des allocataires

Les statistiques sur-représentant les quartiers où patrouillent gendarmes et policiers, LQDN souligne à ce titre que les logiciels de police prédictive « soulèvent un important risque d’effet d’auto-renforcement » (ou « feedback loops ») et de produire « une prophétie auto-réalisatrice en concentrant des moyens importants dans des zones déjà en proie aux discriminations et à la sur-policiarisation ».

L'analyse des données recueillies « tendent en effet à montrer que, dans leur principe même, ces systèmes automatisés contribuent à amplifier la surveillance et la domination policières exercées sur des populations déjà en proie à des discriminations systémiques, en justifiant à la fois une surveillance accrue et des contrôles policiers à leur encontre ».

Renforcer le management et la traçabilité des patrouilles

La Quadrature estime par ailleurs qu' « en dépit de l’absence d’évaluation officielle, les données disponibles semblent confirmer l’absence de valeur ajoutée des modèles prédictifs pour atteindre les objectifs que la police s’était fixés ».

En termes d'efficacité dans la prévention ou la préemption des infractions, elle relève que les quelques études indépendantes disponibles « évoquent des effets au mieux ambivalents ».

Deux économistes ayant tenté d’évaluer les effets de PAVED à partir des statistiques nationales de la délinquance notent ainsi une diminution du nombre de vols de voiture, possiblement en raison des patrouilles de police, mais pas du taux de cambriolages à domicile.

Par ailleurs, ces technologies « semblent loin d’avoir convaincu leurs utilisateurs et utilisatrices ». Predvol « ne ferait pas mieux que la simple déduction humaine ». Quant à PAVED, « il s’avère décevant en termes de capacités de prévision ».

De plus, et comme le montre les travaux sociologiques menés sur ces systèmes, ils s’interprètent avant tout comme une manière de « rationaliser le management et de renforcer la traçabilité des patrouilles ».

L’opacité institutionnelle entretenue autour de ces technologies

La Quadrature relève par ailleurs que les exigences énoncées par le Conseil constitutionnel dans sa jurisprudence sur les algorithmes imposent notamment de prévoir des possibilités de recours administratifs pour les personnes concernées.

Or, ces exigences législatives et jurisprudentielles « ne semblent pas respectées » s’agissant des systèmes de police prédictive, avance l'ONG, qui n'a pas constaté de « tentative significative et proactive » d’informer les citoyens et les autres parties prenantes sur le fonctionnement exact de ces systèmes, « en dehors des quelques informations parfois disséminées de manière opportuniste au début de l’implémentation de ces technologies ».

Interrogée via deux demandes CADA en mars 2022 et novembre 2023, la CNIL a en outre indiqué à LQDN qu’elle n’avait jamais reçu ou produit de document relatif aux logiciels de police prédictive dans le cadre de ses prérogatives. Ce qui interpelle l'ONG, alors que, « pour certains, ils sont utilisés par des milliers d’agents de police municipale à travers le pays ».

Un défaut de contrôle et de transparence souligné par ses autres demandes CADA, qui n'ont donné lieu qu’à des « informations partielles », se heurtant « le plus souvent à l’absence de réponse, notamment de la part du ministère de l’Intérieur ».

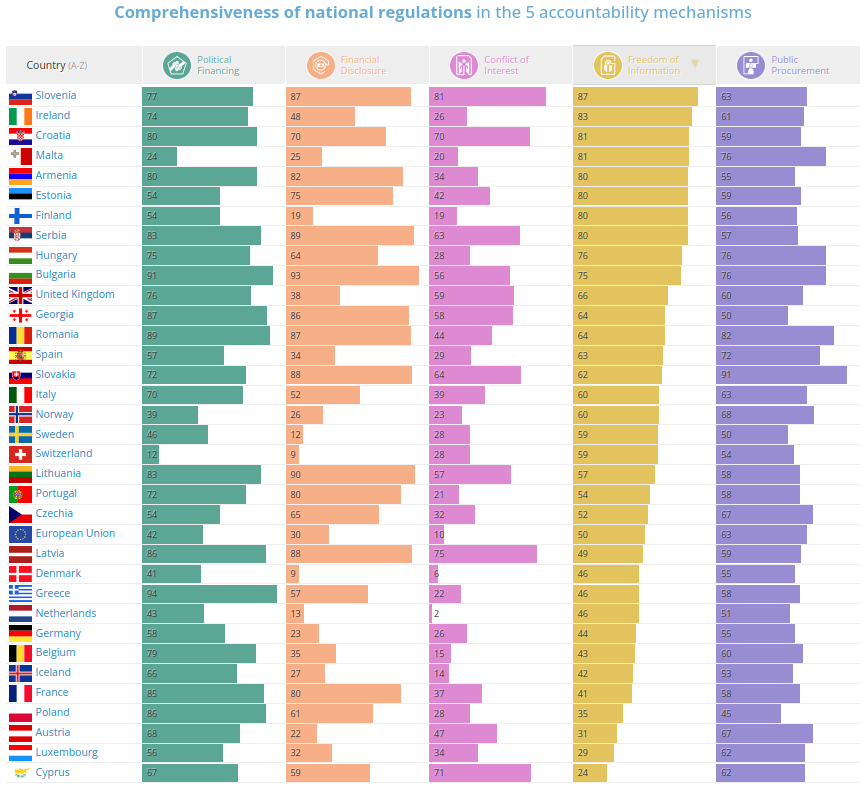

Elle rappelle, à ce titre, que la France « fait très mauvaise figure dans le classement de la liberté d’information », arrivant en 31e position sur 35 au classement établi par EuroPAM (pour Mécanismes européens de responsabilité publique), devant la Pologne, l'Autriche, Luxembourg et Chypre. Un programme, financé par l'UE, qui vise à « améliorer la confiance dans les gouvernements et l'efficacité des dépenses publiques à travers l'Europe ».

« Le contrôle institutionnel des systèmes de police semble donc totalement défaillant », déplore l'ONG : « au final, sur ce sujet comme sur d’autres que nous couvrons dans le cadre de la campagne Technopolice, le principal obstacle à notre enquête réside dans l’opacité institutionnelle entretenue autour de ces technologies de police prédictive et de leurs usages ».

Elle note en outre que « les chercheurs et chercheuses que nous avons rencontrés semblent partager les mêmes difficultés que nous ».

Une absence flagrante d’encadrement, en dépit de piètres résultats

Dans la conclusion de son rapport, l'ONG déplore que « sous couvert d’"objectivité algorithmique", ces dispositifs semblent avoir conduit les forces de police à abuser de leurs prérogatives ».

Et ce, alors que « dans leur principe même, la plupart de ces systèmes automatisés contribuent à renforcer la surveillance et la domination policières exercées sur des populations déjà en proie à des discriminations systémiques ».

LQDN souligne également que « les grands principes juridiques qui encadrent la surveillance d’État au niveau européen, et notamment l’exigence d’une base légale claire et accessible incorporant un certain nombre de gardes-fous », ont pourtant été rappelés en février 2023 par la cour constitutionnelle allemande dans une décision relative à l'utilisation d'un logiciel de Palantir par la police du Land allemand de Hesse.

En France, poursuit l'ONG, « ils semblent totalement ignorés, et le peu d’informations disponibles obère de toute façon l’exercice du droit à un recours effectif à l’encontre de ces dispositifs et leur usage par la police ».

- Le Tribunal constitutionnel allemand oblige la police à abandonner un système de police prédictive

- AI Act : le texte interdit désormais la reconnaissance faciale, la notation sociale et la police prédictive

De même, « les principes de non-discrimination et d’évaluation des algorithmes de police prédictive afin de réduire le risque de biais – principes mis en exergue dans un rapport récent de l’Agence européenne des droits fondamentaux 87 – ne semblent pas respectés ».

Or, et « malgré une absence flagrante d’évaluation, d’encadrement législatif et en dépit de piètres résultats opérationnels », les promoteurs de ce type de technologies « continuent d’entretenir la croyance selon laquelle l’"intelligence artificielle" pourra permettre de rendre la police plus "efficace" », relève l'ONG.

Elle relève enfin que « même si un certain nombre d’entre eux ont été abandonnés où ne sont utilisés que marginalement par les forces de police, d’autres continuent d’être développés, expérimentés et intégrés aux pratiques opérationnelles », et que « des investissements financiers conséquents sont

toujours consentis pour leur mise au point ».

Ce pourquoi elle estime « urgent de mettre un coup d’arrêt à l’utilisation de ces technologies pour ensuite conduire une évaluation rigoureuse de leur mise en œuvre, de leurs effets et de leurs dangers ».

La Quadrature réitère son appel à l’interdiction des logiciels de police prédictive

-

La « statistique morale », discipline à l’origine de la criminologie

-

Un « instrument clé » de la « politique du chiffre »

-

Corrélation n’est pas causalité, des données biaisées

-

Renforcer le management et la traçabilité des patrouilles

-

L’opacité institutionnelle entretenue autour de ces technologies

-

Une absence flagrante d’encadrement, en dépit de piètres résultats

Commentaires (11)

Vous devez être abonné pour pouvoir commenter.

Déjà abonné ? Se connecter

Abonnez-vousLe 24/01/2024 à 15h41

Article intéressant sur un danger de logiciels stupides à mon sens et dont il faut se prémunir.

Modifié le 24/01/2024 à 17h27

Modifié le 24/01/2024 à 19h20

Cette médiocrité statistique, provenant d'une constante baisse des capacités mathématiques basiques de la population, permet aux absurdités de se répandre sous couvert de "bon sens" & autres biais.

L'absurdité mène au danger, façon idiocratie, où une apparence d'intelligence suffit à en être qualifié. L'apparence, encore & toujours.

Nous sommes collectivement tellement nuls en mathématiques (outils statistiques) & en philosophie (outils de réflexion & d'analyse de biais) que la montée des extrémismes, de la xénophobie, de l'accablement de minorité créées sur des motifs absurdes (généralement reliés à de l'apparence, physiques ou supposés - idées, idéologie, valeurs), du repli sur soi et par la somme des composants, de la violence, n'est finalement pas une si grande surprise, pour qui veut voir.

Le 24/01/2024 à 20h59

Le 25/01/2024 à 11h29

Le 25/01/2024 à 14h53

En résumé "on se disperse".

Mais avec un peu de recul, ça rejoint un paragraphe de cet article : POLITIQUE DU CHIFFRE.

On a des commissariats drivés par le chiffre qui vont classer/ignorer des dossiers pour atteindre leurs objectifs.

Et c'est pas récent, dans le premier film "les ripoux" ils faisaient déjà mention d'une notre interne les invitant à reporter à l'année suivante les interpellations pour ne pas arriver premier au palmarès des quartiers pourris.

Le 25/01/2024 à 16h05

Le 25/01/2024 à 16h26

Modifié le 25/01/2024 à 18h30

Si c'est par GPS ou autre proximité d'une borne WI-Fi, je suis d'accord. La géolocalisation n'est pas assez précise.

Si c'est un PC localisé par Internet par son adresse IP correspondant à un abonnement internet "filaire", avec l'aide du FAI, on sait parfaitement chez quel abonné du FAI il est et le FAI connaît son adresse. On peut donc perquisitionner uniquement chez lui. Par contre, c'est plus compliqué : il faut interroger le FAI.

Le 26/01/2024 à 08h17

Le 28/01/2024 à 14h07

Je crois comprendre les raisons sous-jacentes à cette loi, mais ça participe au sentiment d'impunité des voleurs. C'est dommage.