« Made with AI » : des deepfakes volent les corps d’influenceuses, Meta ajoute une étiquette

"Faked with AI"

Alors que Meta vient d'annoncer l'ajout d' « étiquettes contextuelles » sur les contenus « Made in IA », des escrocs ont commencé à voler les vidéos d'influenceuses et travailleuses du sexe, pour les cloner en y rajoutant des visages générés par des IA.

Le 10 avril à 11h25

4 min

IA et algorithmes

IA

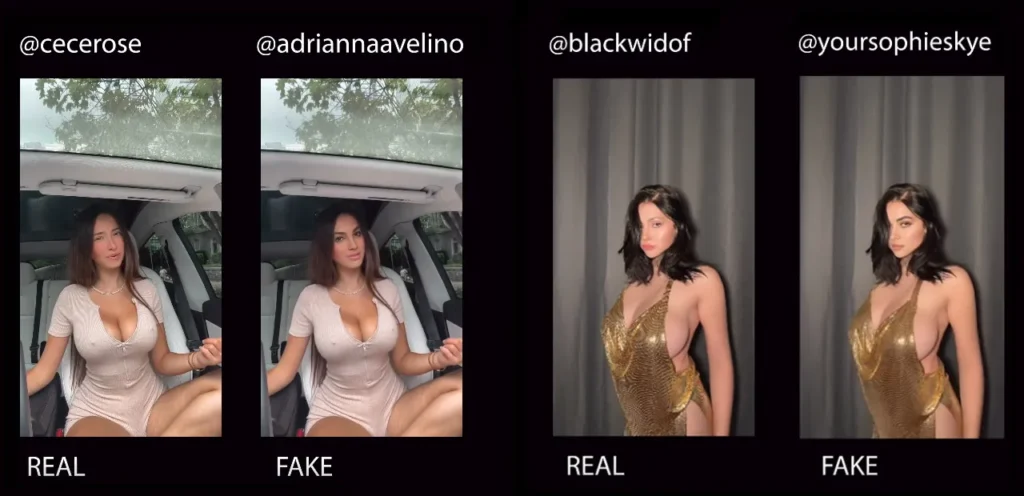

404Media a découvert des comptes Instagram qui volent les vidéos d'influenceuses et travailleuses du sexe, avant de les cloner en substituant leurs visages par des deepfakes générés par des intelligences artificielles, afin de pouvoir monétiser les contenus dérobés.

Vrais corps et décors, faux visages

Certains comptes auraient ainsi accumulé « des centaines de milliers de followers et des millions de vues » en utilisant « presque exclusivement » du contenu volé, tout en renvoyant à des profils payants (de 5 à 20 dollars par mois). 404Media a aussi trouvé plusieurs tutos sur YouTube expliquant comment procéder.

De quoi pouvoir constituer, à peu de frais, un volume important de contenus d'autant plus « crédibles » que les corps sont humains, les décors réels, et que seuls les visages sont générés par IA. Et a priori plus difficiles à identifier comme ayant été générés par des IA, contrairement aux « influenceuses virtuelles » entièrement générées de façon « artificielle ».

- Des influenceuses virtuelles (IA) concurrencent leurs équivalents humains

- Deepfakes pornographiques : quand l’intelligence artificielle sert à humilier

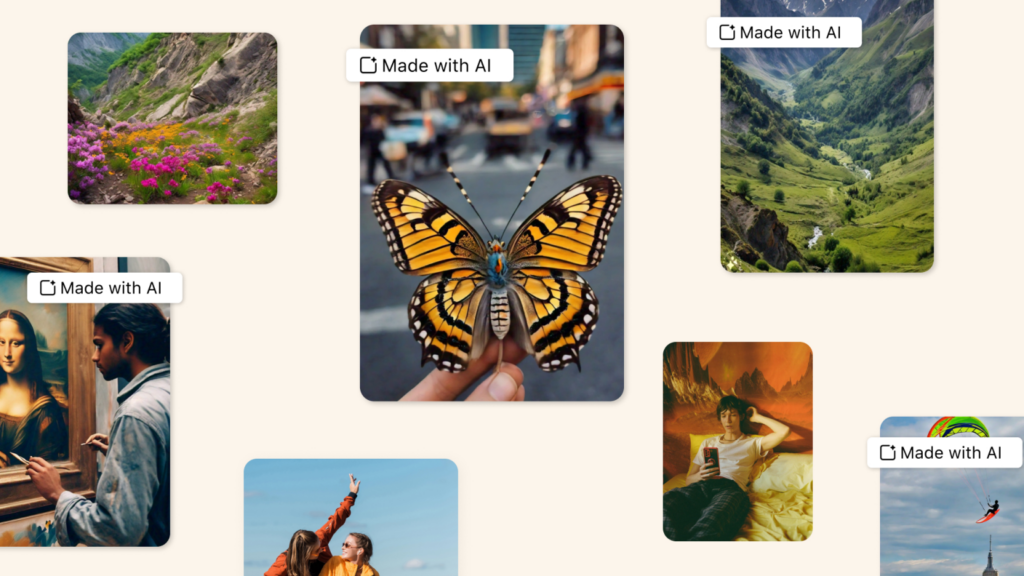

Meta va ajouter un « made with AI »

Contacté, Meta a fermé les comptes signalés. L'entreprise vient par ailleurs d'annoncer qu'elle allait commencer à étiqueter les contenus vidéo, audio et image « made with AI » sur Facebook, Instagram et Threads. Jusqu'à présent, Meta ne labellisait que les seuls contenus manipulés pour « donner l'impression qu'une personne dit quelque chose qu'elle n'a pas dit ».

Meta précise que sa politique relative aux médias manipulés avait initialement été rédigée en 2020, « à une époque où les contenus réalistes générés par l’IA étaient rares et où la préoccupation majeure concernait les vidéos ».

L’étiquette « Made with AI » sera ajoutée via une détection automatique des contenus ou bien si des personnes indiquent d’elles-mêmes qu’elles téléchargent du contenu généré par l’IA. « Nous avons déjà ajouté « Imaginé avec l’IA » aux images photoréalistes créées à l’aide de notre fonctionnalité Meta AI », ajoute le réseau social.

« Nous prévoyons de commencer à étiqueter les contenus générés par l'IA en mai 2024, et nous cesserons de supprimer des contenus uniquement sur la base de notre politique relative aux vidéos manipulées en juillet. Ce calendrier donne aux internautes le temps de comprendre le processus d'auto-divulgation avant que nous ne cessions de supprimer le sous-ensemble plus restreint des médias manipulés. »

Meta, les étiquettes contextuelles et la liberté d'expression

Son Conseil de surveillance a également fait valoir que « nous risquons inutilement de restreindre la liberté d'expression lorsque nous supprimons des médias manipulés qui ne violent pas autrement nos normes communautaires », et recommandait donc une approche « moins restrictive » des médias manipulés avec le rajout de telles « étiquettes contextuelles ».

« Si nous déterminons que des images, des vidéos ou des sons créés ou modifiés numériquement présentent un risque particulièrement élevé de tromper le public sur un sujet important, nous pouvons ajouter un label plus visible afin que les gens disposent de plus d'informations et d'un meilleur contexte. »

Meta a également mené une enquête d'opinion auprès de plus de 23 000 personnes dans 13 pays, leur demandant notamment comment les entreprises de médias sociaux devraient aborder les contenus générés par l'IA sur leurs plateformes : « une grande majorité (82 %) est favorable à l'apposition d'étiquettes d'avertissement sur les contenus générés par l'IA qui montrent des personnes disant des choses qu'elles n'ont pas dites ».

IA ou humain, la règle est la même

« Nous supprimerons le contenu, qu'il soit créé par l'IA ou par une personne, s'il enfreint nos politiques contre l'ingérence dans les élections, l'intimidation et le harcèlement, la violence et l'incitation, ou toute autre politique de nos normes communautaires », souligne Meta.

« Made with AI » : des deepfakes volent les corps d’influenceuses, Meta ajoute une étiquette

-

Vrais corps et décors, faux visages

-

Meta va ajouter un « made with AI »

-

Meta, les étiquettes contextuelles et la liberté d’expression

-

IA ou humain, la règle est la même

Commentaires (10)

Vous devez être abonné pour pouvoir commenter.

Déjà abonné ? Se connecter

Abonnez-vousLe 10/04/2024 à 12h21

potentiellementprobablement faux.Vive le progrès.

Le 10/04/2024 à 12h35

Le 10/04/2024 à 15h19

Le 10/04/2024 à 16h01

Le 10/04/2024 à 15h42

/Je suis déjà loiiiiin

Le 10/04/2024 à 15h56

Le 10/04/2024 à 17h23

Le 11/04/2024 à 10h40

Le 10/04/2024 à 16h41

Le 11/04/2024 à 11h33

Dans ce cas il y a en plus le vol d'image, certes mais quelqu'un qui utilise un filtre actif pour avoir l'air "manga-ifié" ou "maquillé" aura-t-il un tag "made by ia" ?