Microsoft lance son Copilot for Security en version finale

Le 03 avril à 06h56

1 min

IA et algorithmes

IA

L’entreprise n’en finit plus de décliner son Copilot pour tous ses produits et services. Le nouveau venu est à destination des clients Azure uniquement et veut simplifier la gestion de la sécurité en permettant d’orienter des recherches par des prompts adaptés.

Le service concentre les informations de plusieurs sources, notamment de Microsoft Defender Threat Intelligence, dont les contenus sont consultables sans frais supplémentaires. Il permet de générer rapidement des vues pour observer des situations ou évènements précis, de créer des résumés pour les incidents, aide à répondre à ces derniers, peut procéder à de la rétro-ingénierie inverse sur les scripts malveillants, etc.

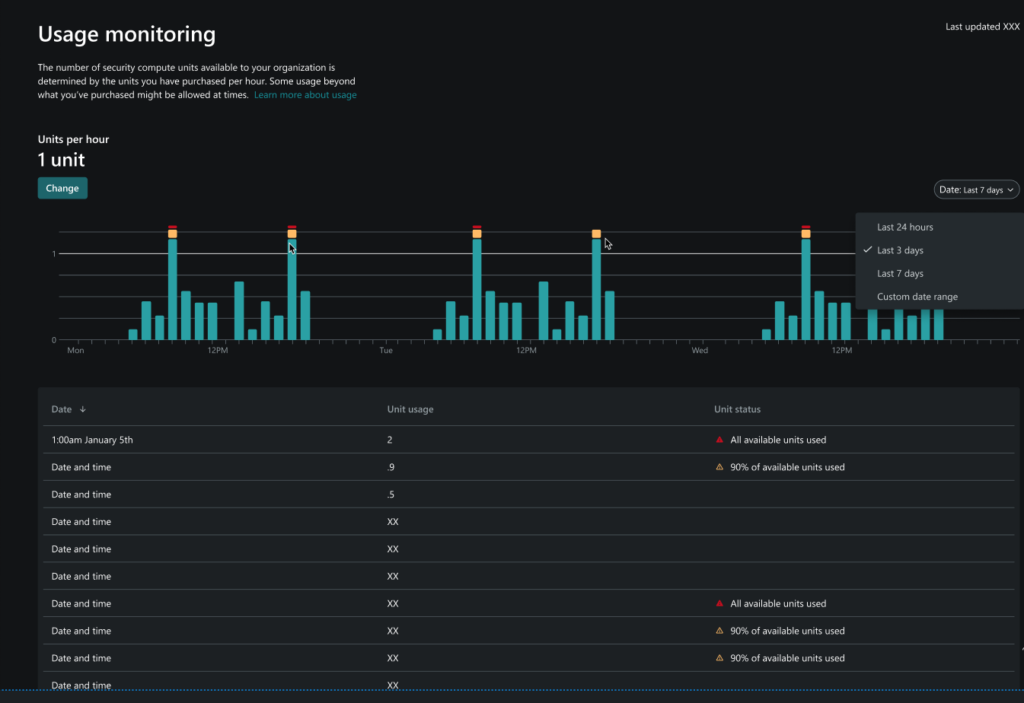

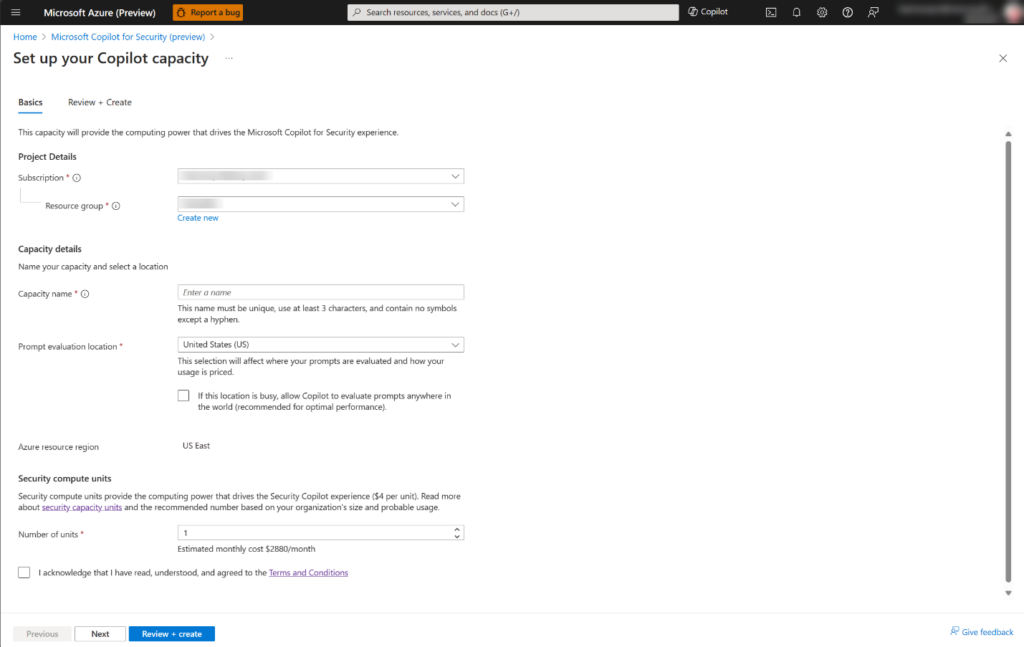

La tarification du Copilot for Security se fait à l’usage. L’activité se mesure en SCU (Security Compute Unit), que Microsoft décrit comme « une unité de mesure de la puissance de calcul nécessaire pour exécuter les charges de travail de Copilot for Security dans des environnements autonomes et intégrés ».

Le 03 avril à 06h56

Commentaires (6)

Vous devez être abonné pour pouvoir commenter.

Déjà abonné ? Se connecter

Abonnez-vousLe 03/04/2024 à 08h42

Le 03/04/2024 à 08h56

Le 03/04/2024 à 12h08

Le 03/04/2024 à 16h52

La sécurité c'est pour les "pro", et les "pro" n'ont pas besoin qu'on leur dise où est le problème ?

Si on va dans ton sens, ca voudrait dire que les warnings/errors d'un compilateur c'est pour les NoBrain car les développeurs "pro" n'ont pas besoin qu'un outil qui leur dise quelle ligne de code à un problème.

Perso je pense au contraire que la technologie doit justement aider les gens qui n'ont ni les compétences ni le temps/envie d'acquérir ces compétences.

Ce que je trouve dangereux, c'est de ne pas connaitre les limites de la technologie et se laisser convaincre que l'expertise 'humaine" n'est plus nécessaire.

Le 08/04/2024 à 09h37

Le 03/04/2024 à 09h25

Pour faire de la sécurité, il n'y a pas de secret, ça passe par la maîtrise complète de l’environnement: infrastructure système, réseau et code applicatif. Épaulé par des "[web] application firewall" et de la supervision qui analyse le comportement. Évidement, veille quotidienne et mise à jour de chaque brique qui compose le produit.