La Russie, première pourvoyeuse de réseaux d’activités inauthentiques sur les plateformes de Meta

Les comptes de personnalités publiques particulièrement visés

Si elle est loin d’être la seule, la Russie reste le pays d’origine de la majorité des réseaux d’activité inauthentique repérés et limités par les équipes de Meta. Pour l'heure, mis à part le volume de contenus faux publiés, l'IA générative ne change pas grand-chose aux menaces repérées.

Le 26 août à 14h57

9 min

Réseaux sociaux

Sociaux

Dans son rapport trimestriel sur les activités inauthentiques (coordinated inauthentic behavior, CIB) détectées sur ses plateformes, Meta détaille six opérations d’influence organisées depuis la Russie, le Vietnam et les États-Unis.

Signé par Margarita Franklin, Mike Torrey, David Agranovich et Mike Dvilyanski, le document se penche aussi sur l’usage d’intelligence artificielle générative par les acteurs malveillants. À l’heure actuelle, ces technologies ne semblent leur apporter que des « gains en termes de productivité et de génération de contenus », sans menacer les capacités de Meta à « perturber leurs opérations ».

Les auteurs du rapport invitent par ailleurs journalistes et personnalités publiques à rester vigilantes – de même que le grand public. En effet, les réseaux d’influence tendent de plus en plus à viser les personnes suivies par de larges communautés pour crédibiliser leurs faux récits. Les personnalités politiques et médiatiques sont aussi plus à risques de subir des tentatives de piratage de leurs comptes sociaux.

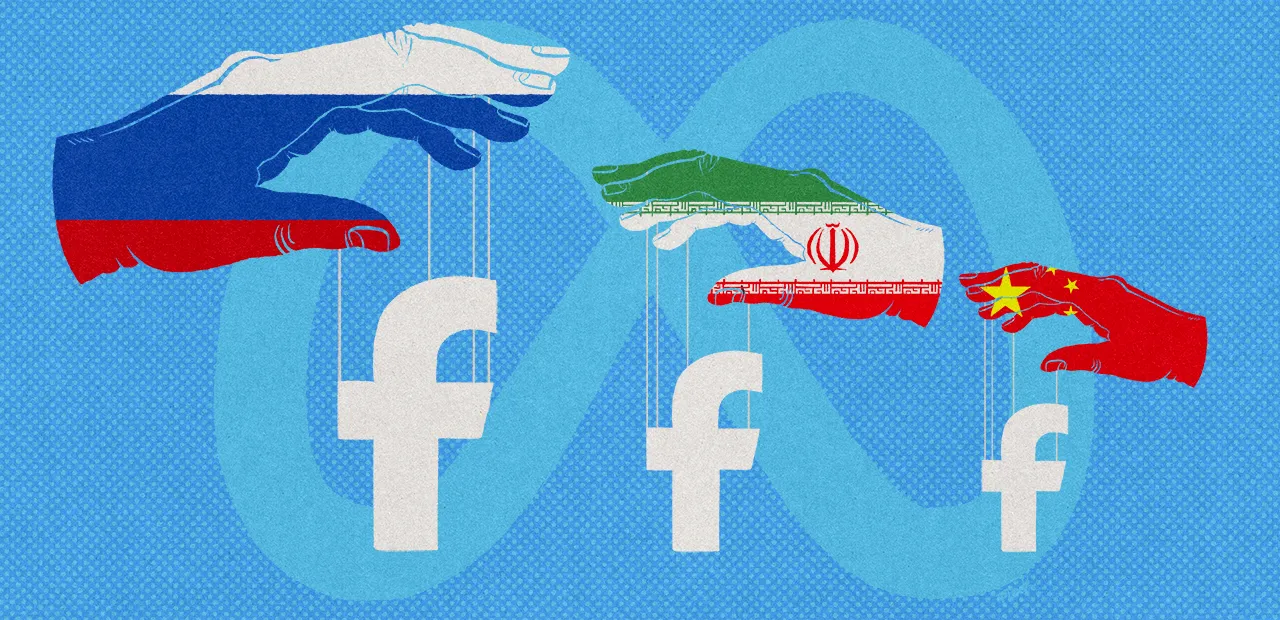

La publication du premier rapport de Meta sur les comportements inauthentiques remonte à 2017. Depuis, souligne l’entreprise, la Russie reste la première source de ce type d’actions – l’équipe en charge de la lutte contre les menaces affirme avoir mis des bâtons dans les roues de 39 opérations d’influence issues de ce pays. À sa suite, elle indique que le deuxième auteur d’interférence est l’Iran (30 réseaux repérés) et la Chine (11).

La Russie, premier adversaire

Le comportement des agents d’influence russes a évolué avec le temps, soulignent les auteurs du rapport. Au départ, ces derniers agissaient sur une variété de sujets, « des guerres culturelles à des questions sociales inflammables ».

Depuis 2022, en revanche, les propos se sont spécialisés autour de la décrédibilisation de l’Ukraine, que ce soit vers des publics nationaux ou étrangers. Meta s’attarde sur quatre réseaux différents dont l’origine a été retracée en Russie, et les cibles sont variées. L’un d’eux visait des publics francophones et anglophones partout dans le monde ; un autre s’attaquait plus spécifiquement aux publics de Géorgie, d’Arménie et d’Azerbaïdjan ; les deux autres visaient l’Ukraine et, à échelle variée, les publics de plusieurs de ses alliés, dont la France.

En amont des élections aux États-Unis, les auteurs du rapport préviennent que les réseaux russes de manipulation de l’information devraient soutenir les candidats qui s’opposent à aider l’Ukraine et critiquent ceux qui la soutiennent dans leurs discours, en décrivant ces aides comme un coût de plus pour l’économie états-unienne ou en renforçant les discours pro-Russes.

De l’IA dans les contenus, plus que dans les comportements

Une campagne Russe a consisté à publier un large volume de textes ressemblant à des articles authentiques, notamment issus de médias mainstream. D’autres étaient publiés à partir de médias fictifs, et d'autres encore adaptés au format vidéo, avec des lectures de journaux générés par IA et publié sur YouTube avant d'être repartagés sur Facebook ou Instagram. Dans chacun de ces cas, l'intelligence artificielle a facilité le travail des acteurs malveillants.

Outre ces contenus, l’IA générative a été utilisée pour créer des personnages fictifs, notamment de journalistes, dont les profils sur les réseaux sociaux sont généralement affublés d’une image générée par des réseaux adversariaux génératifs (GAN). Cette tendance n’a rien de neuf : Meta la suit depuis 2019.

En termes d'acteurs, les auteurs du rapport soulignent l’apparition de nouvelles entités commerciales derrière les opérations en faveur des opérations russes. Ceci traduit une tendance observée de plus en plus fréquemment dans les enquêtes sur les réseaux russes de manipulations de l’information : ces derniers ne sont pas tant pilotés directement par les agences du gouvernement local que le fruit de toute une économie de contractuels.

Ces derniers proposent des campagnes plus ou moins clés en main, et produisent des opérations de faible qualité, mais avec de forts volumes de publications. Meta souligne qu’il s’y glisse tant d’erreurs que des internautes réels qualifient eux-mêmes ces comptes de trolls.

Doppelgänger, toujours présent

En matière de persistance des acteurs de la menace, les auteurs du rapport soulignent une évolution notable. Si, par le passé, de nombreuses opérations russes ont muté, voire ont disparu suite à la perturbation de leurs activités par les équipes de Meta, de nouveaux réseaux actifs depuis 2022 démontrent une résistance nouvelle. C’est en particulier le cas du réseau Doppelgänger, qui s’est appuyé sur des outils d’IA générative pour créer des visuels uniques, destinés à tenter d’outrepasser les efforts de détection automatisée.

Comme l’ont montré le réseau Antibot4navalny, ou encore les travaux d’OpenAI, l’IA semble lui servir aussi pour traduire ses contenus d’une langue à l’autre.

Meta qualifie Doppelgänger d’ « opération d’influence Russe la plus persistante ». En réponse aux détections de ses équipes, cette dernière crée en permanence de nouveaux contenus, mais fait « peu d’efforts pour construire des audiences sur les réseaux sociaux ». Elle semble en revanche « opérer des efforts intensifs dans l’opération de ses sites web, probablement dans une tentative de protéger ses contenus contre les interférences continues » opérées par les équipes des réseaux sociaux.

« Sans effort concerté pour perturber l’infrastructure internet qui alimente ces campagnes, nous prévoyons que ces opérations centrées sur les sites web persistent aussi longtemps que leurs clients le leur demanderont, quelle que soit leur efficacité », indiquent les auteurs.

Appui sur des personnes réelles

Le rapport de Meta met par ailleurs l’accent sur deux façons qu’ont les réseaux d’influence russe en ligne d’utiliser des personnes réelles pour amplifier leurs actions. Ils pointent d'une part l'augmentation des opérations de manipulation réalisées pour être repérées.

Le fondateur de l’Internet Research Agency (IRA) russe Evgueni Prigojine a utilisé, par le passé, cette technique de « hacking de perception », expliquent les auteurs. Le but : utiliser les opérations de l’IRA qui n’ont pas réussi à éviter la modération en articles de recherches ou de médias, afin de présenter ces opérations comme omniprésentes, donc efficaces… même quand elles ne le sont pas.

En pleine année politique, les analystes de Meta appellent à la nuance : ils enjoignent chercheurs et journalistes à continuer leurs travaux pour éviter que les opérations d’influence ne permettent réellement d’amplifier des discours néfastes. Ils soulignent toutefois que « surestimer leur influence risque de diminuer la confiance dans l’environnement informationnel et dans les institutions ».

Autre tactique : les auteurs du rapport soulignent l’usage croissant d’internautes réels, notamment en Europe et en Arménie, pour amplifier leurs campagnes. Ces personnes peuvent être consentantes et conscientes de se prêter à ce jeu ou non. Lorsqu’elles le sont, et qu’elles s’organisent en dehors des plateformes de Meta, il est d’autant plus difficile pour ses équipes de les lier à des réseaux malveillants.

Le rapport souligne par ailleurs que ces campagnes visent plus spécifiquement les journalistes et autres personnalités publiques pour que ces dernières reprennent les récits qui les intéressent et, ce faisant, leur donne une plus large crédibilité.

Des réseaux d’influence issus du Vietnam et des États-Unis

Outre les opérations russes, les auteurs rapportent aussi avoir supprimé plus de cent comptes Facebook, 65 pages et 49 comptes Instagram d’un réseau implanté au Vietnam. Ce dernier visait avant tout le Liban, les États-Unis, le Royaume-Uni et la France. Dans sa version arabe, à destination de publics français et libanais, ses publications critiquaient le rôle de l’Iran dans le conflit Israël-Hamas, et soutenaient la Palestine. En français, ses publications soulignaient le besoin de protéger les valeurs traditionnelles françaises et critiquaient l’islam chiite et les investissements qataris en Europe.

Le rapport décrit aussi une opération d’origine états-unienne, dont près de 100 comptes Facebook, 16 pages, 12 groupes et trois pages Instagram ont été supprimées pour violation des règles relatives aux comportements inauthentiques. Celle-ci se concentrait sur la critique des partis démocrates et républicains traditionnels. Si les personnes à l’origine de cette campagne ont réussi à dissimuler leur identité, les chercheurs de Meta leur ont trouvé des liens « avec une entité installée aux États-Unis et appelée RT Group ».

La Russie, première pourvoyeuse de réseaux d’activités inauthentiques sur les plateformes de Meta

-

La Russie, premier adversaire

-

De l’IA dans les contenus, plus que dans les comportements

-

Doppelgänger, toujours présent

-

Appui sur des personnes réelles

-

Des réseaux d’influence issus du Vietnam et des États-Unis

Commentaires (7)

Vous devez être abonné pour pouvoir commenter.

Déjà abonné ? Se connecter

Abonnez-vousModifié le 26/08/2024 à 15h54

Ce n'est que chez moi, ou ça le fait chez tout le monde? Ça casse ma lecture des articles avec Read Aloud.

(suis sur Firefox).

Le 26/08/2024 à 15h54

Modifié le 26/08/2024 à 16h39

Édit : ça bugue aussi dans les liens mis dans l'article comme : propagande - as - a - service.

Je pense que @Ness_01 doit pouvoir nous corriger cela rapidement.

Le 26/08/2024 à 17h05

Désolée pour le petit coléoptère.

Le 26/08/2024 à 17h14

Le 26/08/2024 à 19h09

Modifié le 26/08/2024 à 22h43