Apple Intelligence : une cascade de fonctions, une disponibilité très limitée

L'intelligence, ce sera plus tard

Apple a fini par présenter ses fonctions alimentées par l’IA. La société rattrape la concurrence sur les capacités, avec une intégration poussée. Cependant, la disponibilité est limitée et lointaine, surtout hors Etats-Unis. Certains aspects du fonctionnement restent flous.

Le 11 juin à 14h44

12 min

IA et algorithmes

IA

Apple Intelligence : c’est désormais le nom officiel pour toutes les fonctions liées à l’IA chez Apple. La firme se permet d’ailleurs de jouer sur les mots, l’appellation pouvant être abrégée « AI ».

La présentation a consisté en un vaste listing de capacités, pour la plupart toutes déjà vues chez un concurrent ou un autre. La vision d’Apple dans le domaine passe par une intégration forte dans ses plateformes, un Siri nettement plus intelligent et – forcément – une protection de la vie privée mise au premier plan. Tout du moins pour les personnes qui y auront droit. Comme on le verra, la disponibilité sera très limitée dans un premier temps.

Si Apple n’a pour l’instant rien de vraiment nouveau à proposer, elle affiche une ligne de départ cohérente. Mais les détails manquent, notamment ce qui est calculé localement et sur le cloud. L’ensemble a du potentiel, mais il lui manque l’essentiel : la disponibilité et des informations concrètes.

- Voir la vidéo de la conférence d'ouverture de la WWDC (sous-titrée en français)

Réécriture, génération d’images, d’emojis : avalanche de fonctions

Si la présentation des nouveautés des plateformes (sur lesquelles nous reviendrons plus tard) a avancé à marche forcée, Apple a pris un peu plus son temps pour ses fonctions IA.

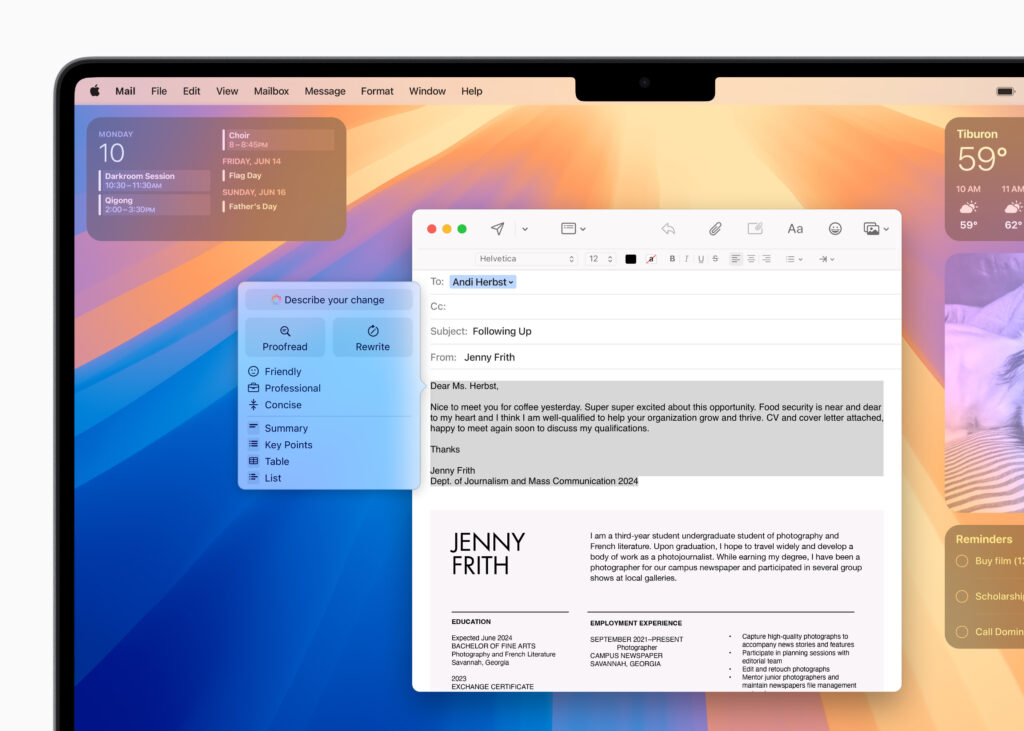

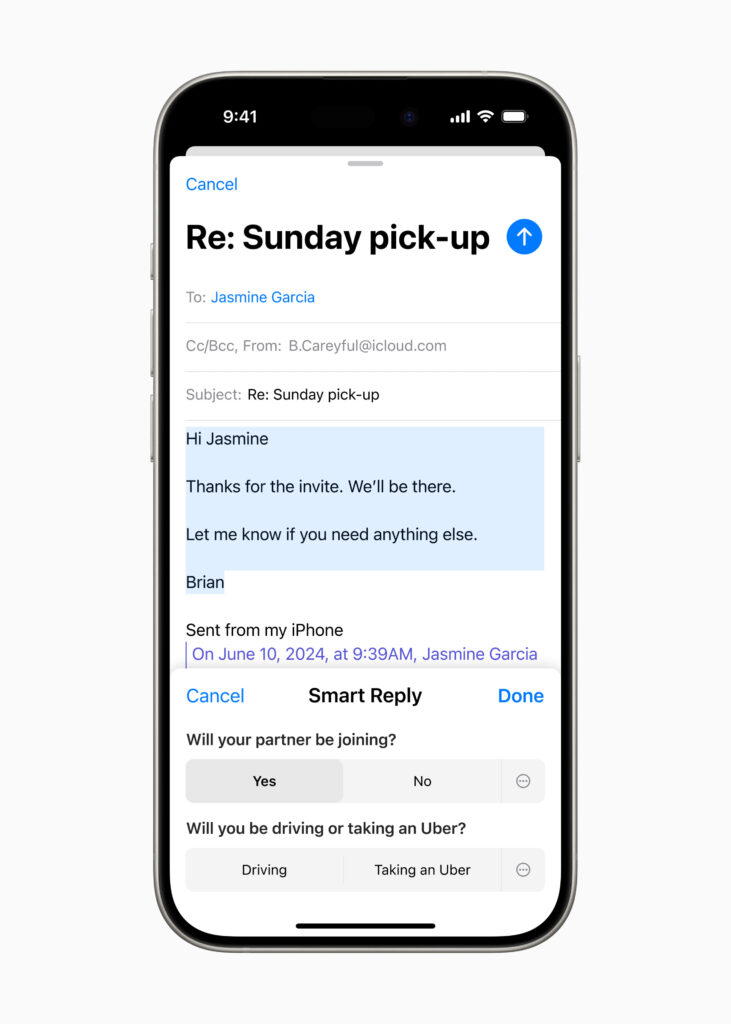

On trouve déjà tout ce qui touche au rédactionnel. Rewrite peut ainsi reformuler en fonction du contexte (ou au choix). La fonction sera disponible partout et proposera plusieurs variations d’un texte, selon l’objectif recherché. Proofread vérifiera de manière plus poussée de la grammaire et la structure syntaxique. Les suggestions seront expliquées.

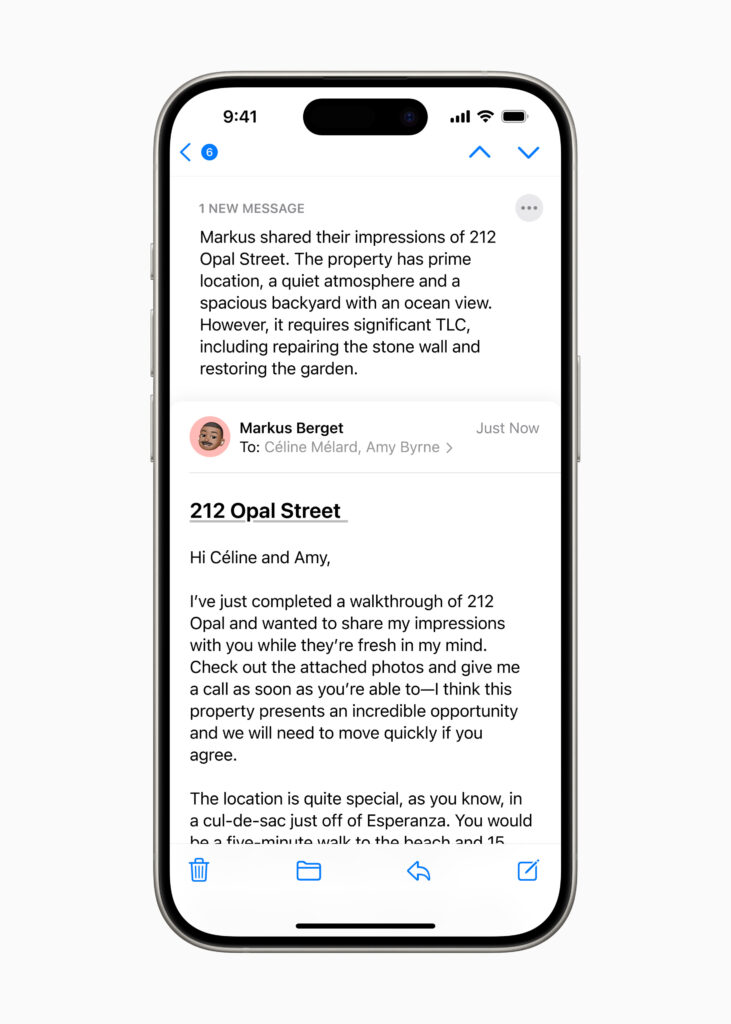

Summarize sera chargée, comme son nom l’indique, de résumer les informations. La fonction sera intégrée à toutes les applications Apple, mais pourra être appelée depuis un clic droit sur une sélection de texte. Selon le contexte et les instructions de l’utilisateur, elle génèrera un condensé des informations considérées comme les plus importantes, une liste de points-clés ou encore un tableau.

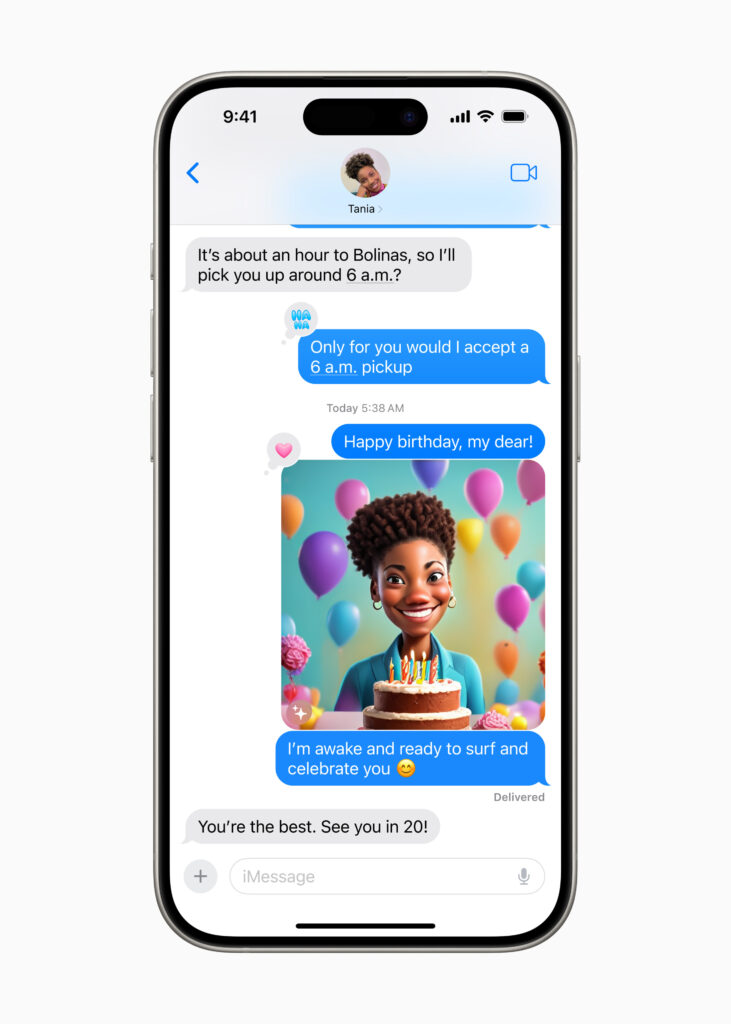

La génération d’images a fait, elle aussi, l’objet d’une présentation approfondie. On la trouve dans une application dédiée, Image Playground, mais la fonction peut aussi être appelée depuis les applications Apple. La capacité sera offerte aux applications tierces via une API.

La génération peut se faire dans trois styles – Animation, Illustration et Sketch – selon des requêtes bien sûr réalisées en langage naturel. Image Playground propose une « myriade de concepts provenant de catégories telles que thèmes, costumes, accessoires et lieux ». Les créations peuvent ensuite être affinées. Selon le contexte, l’utilisateur se verra offrir des suggestions d’illustrations. Dans Notes, les ébauches réalisées au stylet pourront également être retravaillées via Image Playground.

La génération d’images s’étend aussi aux émojis, une fonction nommée Genmoji. On pourra créer ces émojis personnalisés depuis soi-même ou un contact et en demander des variations. Ils seront envoyés en tant qu’émojis dans des messages ou sous forme d’autocollants. Pas un mot en revanche sur la compatibilité avec d’autres appareils.

Organiser, ranger, prioriser

Une partie importante des capacités d’Apple Intelligence sont liées à l’organisation des informations et comment le service peut les prioriser.

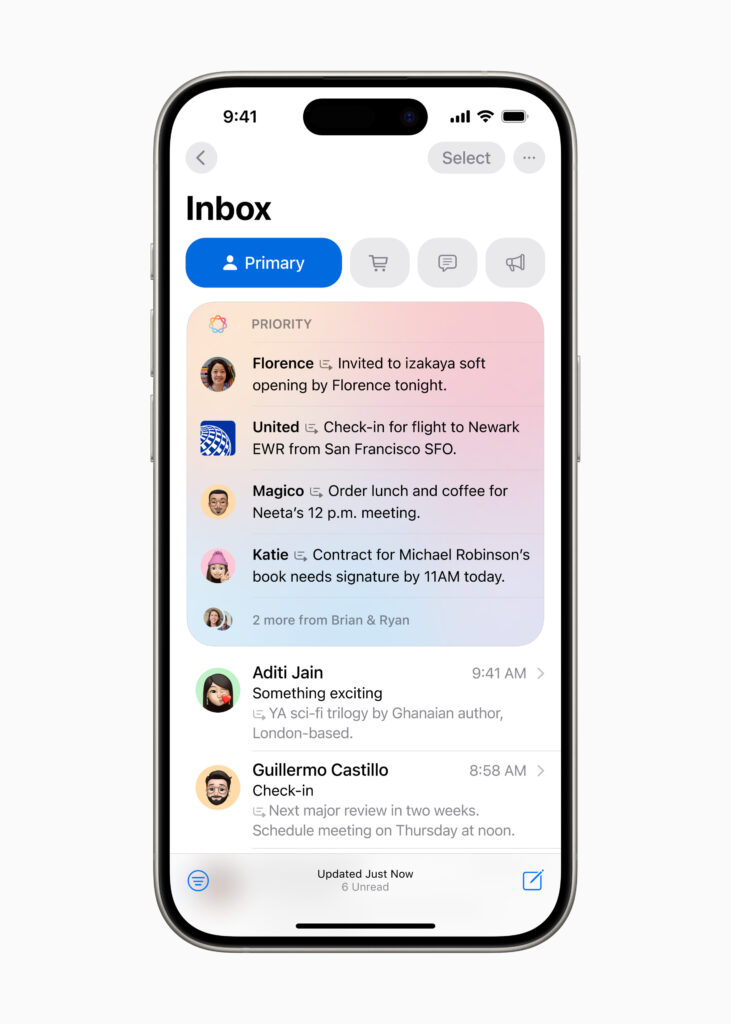

Dans Mail par exemple, Priority Messages va classer les messages selon leur thématique et faire remonter les courriers considérés comme urgents ou importants, comme une invitation pour le jour même. Ce type de classement existe depuis longtemps dans Outlook.com et Gmail. Les emails seront répartis dans des catégories (communications personnelles, promotions…), que l’on peut désactiver. Une catégorie « Tous les emails » est quand même disponible pour avoir la liste classique, par ordre chronologique.

De même, Priority Notifications veut classer les notifications en fonction du contexte, pour éviter les distractions. Il sera donc fait une différence entre des signaux prévenant d’un changement pour la journée en cours et d’autres invitant à découvrir de nouveaux menus, ou les multiples notifications que peuvent envoyer des applications de type médias. Tout ce qui est jugé prioritaire apparaîtra en tête de liste. Le mode Concentration en tient également compte, en n’affichant que ce qui est jugé important.

Dans Photos, la recherche fait un bond. On pourra lancer des requêtes complexes (écrites ou via Siri) de type « chercher toutes les photos de Flock en 2021 et 2022, où il portait un pull orange et en extérieur ». Les informations contextuelles sont extraites par l’IA localement, l’application s’en servant pour proposer des regroupements thématiques. Une trame est automatiquement proposée, mais il est possible de la personnaliser, avec des chapitres et de la musique. Sur ces derniers, des suggestions seront faites.

Des appels enregistrables et résumés

L’application Téléphone va également se doter d’une fonction attendue depuis longtemps : l’enregistrement. Apple affirme que le déclenchement de l’enregistrement avertira automatiquement les correspondants. On ne sait pas encore comment ce message sera transmis aux correspondants. L’enregistrement audio sera ensuite récupéré par l’IA, qui en créera une transcription, ainsi qu’un résumé.

Cette fonction se retrouvera dans Notes. On pourra y intégrer un enregistrement vocal (par exemple, issu de Dictaphone), l’application se chargeant de la transcrire. Là aussi, un résumé pourra être affiché, toujours sous forme de condensé, de liste, de tableau ou autre.

Le Siri nouveau

On attendait bien sûr Apple au tournant sur son assistant vocal. Ce type de fonction a pris un sérieux coup de vieux depuis l’arrivée des modèles d’IA générative grand public, ChatGPT en tête.

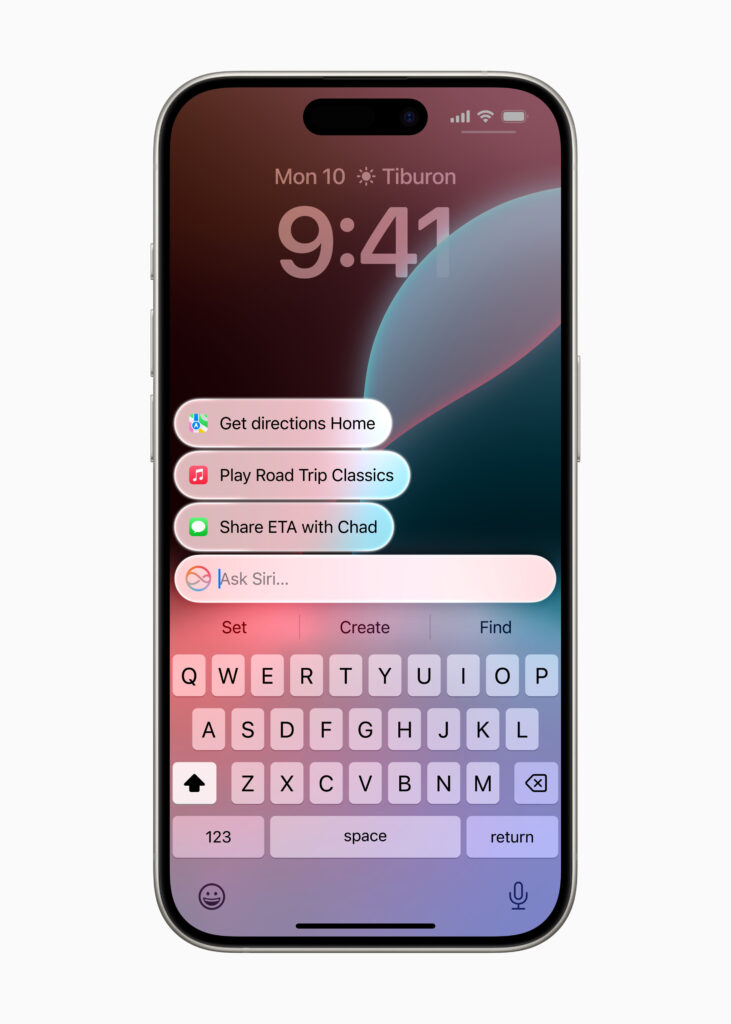

Siri n’échappe pas à la révision générale, avec tout ce que l’on pouvait en attendre. On y trouve donc la prise en compte du contexte (on ne sait pas dans quelles proportions), la possibilité de lancer des requêtes complexes (avec plusieurs paramètres), le suivi de la commande vocale même quand on hésite, répondre à des demandes de renseignements sur les fonctions de l’appareil (même quand on ne connait pas le nom de la fonction, planifier des envois de messages et autres, etc.

Dans les exemples donnés par Apple, on trouve la réception de l’adresse d’un contact dans la conversation. On pourra alors dire « Ajoute cette adresse dans sa fiche contact ». De même, Siri comprendra des instructions comme « Envoie les photos du barbecue de samedi à Caroline », « Lance la lecture du podcast que Luis m’a recommandé » ou encore « À quelle heure atterrit l’avion de maman ? »

En somme, Siri se met au goût du jour. Si rien « d’extraordinaire » ne ressort vraiment, l’idée semble être d’en faire un véritable assistant du quotidien, très intégré. Son appel génère un nouvel effet de halo multicolore autour de l’écran et il sera possible de lui écrire. Cette capacité a été ajoutée pour les cas où l’on ne peut pas parler. Elle a l’avantage de prendre également en compte les habitudes face à l’IA générative, un nombre croissant de personnes s’habituant à écrire des requêtes complexes.

ChatGPT inclus dans toutes les plateformes

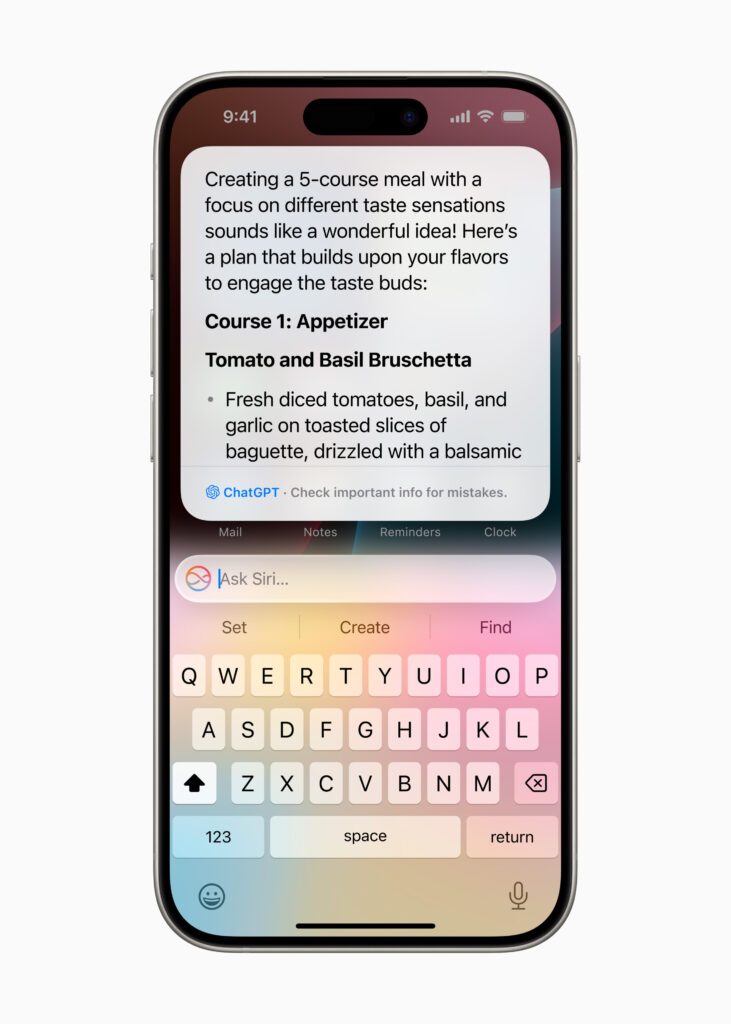

Bien qu’Apple ait sa propre infrastructure pour les requêtes, on ne sait rien de la provenance des modèles. GPT-4o a bien été mentionné, mais uniquement pour signaler que ChatGPT serait présent sur toutes les nouvelles versions des plateformes.

Ce sera particulièrement vrai pour tous les travaux d'écriture ou lors de recherches d'instructions. La fonction intégrée passera par Apple Intelligence, mais la fenêtre de paramétrage permettra d’envoyer la requête vers ChatGPT. Auquel cas, une demande de confirmation apparaitra, informant l’utilisateur qu’il s’apprête à envoyer des données à un tiers.

Il est possible que les propres modèles d’Apple ne soient en fait pas les siens. Les rumeurs d’un rapprochement avec OpenAI étaient vives depuis plusieurs mois. Les négociations ont peut-être abouti à l'autorisation pour Apple de reprendre GPT-4o à son compte, mais avec la possibilité laissée aux utilisateurs d'interroger directement ChatGPT. Dans tous les cas, c'est une immense victoire pour OpenAI.

Vie privée : Apple veut faire la différence

En retard, Apple ne pouvait pas se contenter de s’aligner sur la concurrence. C’est sans surprise que l’entreprise a choisi la protection de la vie privée comme facteur de différenciation. Une très bonne idée bien sûr, mais qui manque cruellement de détails.

On sait ainsi que la « majorité » des modèles fonctionneront localement. Quand la requête aura besoin de plus de puissance, elle sera envoyée aux serveurs d’Apple. L’entreprise a baptisé son infrastructure Private Cloud Compute pour refléter des serveurs bâtis avec ses propres machines, donc avec des puces Apple Silicon. Tout ce qui transite par ces serveurs n’est censé laisser aucune trace.

« Des experts indépendants peuvent inspecter le code qui s’exécute sur les serveurs alimentés par les puces Apple pour en contrôler la confidentialité », indique Apple. En outre, Private Cloud Compute « garantit cryptographiquement que l’iPhone, l’iPad et le Mac ne communiquent avec un serveur que si son logiciel a été publiquement enregistré pour inspection », sans que l’on sache vraiment ce que cela signifie.

Mais le message est passé : le traitement de l’intelligence artificielle chez Apple se fera localement « aussi souvent que possible » ou sur des serveurs ne gardant pas de trace des données personnelles.

Appareils compatibles : aïe

Affirmer que « nombre des modèles impliqués s’exécutent entièrement sur l’appareil » a une conséquence aussi directe que brutale : une disponibilité très limitée sur les appareils.

Apple a manifestement souhaité que l’ensemble ait de bonnes performances. En clair, pour les iPhone, seuls les modèles 15 Pro et 15 Pro Max prendront en charge Apple Intelligence. D’ici à ce qu’iOS 18 soit disponible, la gamme 16 aura été officialisée, mais cela laissera très peu de modèles compatibles.

D’un point de vue stratégique, cette annonce a beaucoup d’avantages. Apple est clairement en retard dans l’élaboration de ses fonctions dopées à l’IA. Une disponibilité restreinte permet de gérer plus confortablement l’afflux des requêtes aux serveurs (puisqu’il y en aura). Elle garantit également une bonne expérience, sans attendre pendant de longues secondes la réponse d’une requête à Siri par exemple. En outre, puisque tous ces mécanismes doivent fonctionner en tâches de fond, la puissance requise permettra sans doute aux informations importantes d’être mises en avant de manière fluide.

Bien sûr, c’est aussi un très bon moyen de pousser les clients vers des appareils récents. À ce sujet, c’est cependant la première fois qu’une fonction aussi importante n’est disponible que pour la toute dernière génération d’iPhone. Il est probable que la présentation de l’iPhone 16 soit largement axée sur les capacités de calculs de son NPU (Neural Processing Unit)

Et pour les autres appareils ? La situation est un peu plus simple : tout Mac ou iPad doté au moins d’une puce M1 sera capable de faire tourner Apple Intelligence. Les différences de puissance du Neural Engine sont importantes entre les différentes générations, mais Apple ne précise pas si une machine avec un SoC M1 aura plus souvent recours au Private Cloud Compute qu’une autre en M4.

Disponibilité temporelle : aïe aïe aïe

Voilà pour la disponibilité matérielle. Qu’en est-il maintenant de l’arrivée concrète sur ces appareils ? Cette fois, c’est le grand flou. Les fonctions Apple Intelligence ne seront pas disponibles durant tout le cycle bêta cet été. On ne sait même pas si elles seront présentes dans les versions finales. Apple s’est contenté d’annoncer cet automne, sous forme de préversion. Il pourrait même y avoir une liste d'attente, si l'on en croit MacRumors.

Et non seulement on ne sait pas quand Apple Intelligence arrive vraiment, mais elle ne le fera qu’en anglais aux États-Unis dans un premier temps. Et pour les autres marchés ? « Dans le courant de l’année prochaine ». Quels marchés ? Apple n’a rien dit.

Une chose est sûre : les Français et Françaises munis d’un iPhone 15/16 Pro n’auront aucune de ces capacités présentées en grande pompe avant l’année prochaine au minimum. iOS/iPadOS 18 et macOS 15 Sequoia ne manquent pas d’attraits (comme nous le verrons), mais Apple Intelligence représente clairement le plus gros argument de ces plateformes.

Ce flou conséquent est probablement la conséquence du retard pris par Apple. Tout semble avoir été décidé bien tard, au point que rien n’est vraiment prêt. L’indisponibilité dans les bêtas en dit long, de même que les premiers pas en préversion dans un seul marché.

Apple Intelligence : une cascade de fonctions, une disponibilité très limitée

-

Réécriture, génération d’images, d’emojis : avalanche de fonctions

-

Organiser, ranger, prioriser

-

Des appels enregistrables et résumés

-

Le Siri nouveau

-

ChatGPT inclus dans toutes les plateformes

-

Vie privée : Apple veut faire la différence

-

Appareils compatibles : aïe

-

Disponibilité temporelle : aïe aïe aïe

Commentaires (13)

Vous devez être abonné pour pouvoir commenter.

Déjà abonné ? Se connecter

Abonnez-vousLe 11/06/2024 à 15h25

–- les gars, je vous ai convoqués pour trouver de nouvelles fonctionalités utilisant l’AI à intégrer dans nos produits. Bon, ça sert à rien, mais si on en met pas, on va vraiment passer pour des losers! J’attends vos idées!

–- un générateur d’émojis!

–- un générateur d’images cartoons!

–- Stupide! Vous n’avez vraiment que des idées de fonctionalités pour débiles mentaux ?

–- Mais chef, nos stats indiquent que 83% de nos clients utilisent TikTok plus de 4h par jour.

–- ah merde, j’oublie tout le temps! C’est vrai qu’il ne doit pas leur rester grand chose comme cerveau… Bon, autre chose ?

–- Chef, on enregistre déjà tout ce que les utilisateurs font sur leur Iphone. Si on passait tout cela à la moulinette de l’AI pour leur fournir « une expérience personnalisée », comme ils disent au marketing ?

–- T’es dingue! Les gens n’en voudront jamais! Il y en a encore pleins qui croient en l’existence de la vie privée! Pire que le Père Noël! Non! Il faut rester discret!

–- On pourrait leur dire que, nous, on fait ça « de façon privée dans le cloud » (rires). Après tout, chez Apple, c’est « la sécurité et la vie privée d’abord… » (éclat de rire général)

–- C’est vrai qu’il l’ont déjà gobé plein de fois et puis, plus c’est gros, plus ça passe…

–- Chef, j’ai une idée. Si on rendait les fonctions AI disponibles uniquement sur nos Iphones les plus hors de pr… euh, je veux dire, les plus haut de gamme. Ca pourrait inciter les clients à changer leur Iphone plus tôt, pour un plus cher, même si il n’en ont franchement pas besoin…

–- ça , c’est une vraie idée Apple ! Bravo, mon petit Jean-Mi! Vous irez loin!

Le 11/06/2024 à 17h06

Modifié le 11/06/2024 à 18h06

celle d'ovancantfort est vraiment très drôle

Bien joué

Le 11/06/2024 à 18h33

Le 11/06/2024 à 18h36

Alors qu'en comparaison, Microsoft qui pousse un usage de l'IA "à la Timeline", qu'ils ont abandonné parce que tout le monde s'en foutait. Ils espèrent vraiment que ça marchera mieux avec de l'IA ?

Modifié le 11/06/2024 à 16h36

Le 11/06/2024 à 16h15

Il leur faut au moins 8Go pour faire tourner les fonctions d'AI en local. Et seuls les plus gros modèles ont cette quantité (alors que sur Android, c'est beaucoup plus commun).

Apple est un peu pris à son propre jeu: leurs puces et système sont tellement bien optimisés qu'ils n'ont jamais eu besoin de beaucoup de RAM. Jusqu'à maintenant…

Le 11/06/2024 à 16h37

Le 11/06/2024 à 17h13

Le 12/06/2024 à 13h04

Bref la raison peut-être aussi technique mais comme on ne sait pas exactement ça peut aussi bien être commercial.

Modifié le 12/06/2024 à 14h43

Edit : je suis allé relire (en diagonale

Le 11/06/2024 à 17h22

Le 11/06/2024 à 18h05