Google I/O : tout ce qu’il faut retenir de l’édition 2022

Because I'm API

Le 17 mai 2022 à 09h39

18 min

Logiciel

Logiciel

La conférence I/O est l’occasion pour Google de présenter de nouveaux produits, mais elle est surtout dédiée aux développeurs. Dans ce domaine, les annonces sont nombreuses et variées, puisque presque toutes les technologies de l’entreprise sont concernées. Voici un résumé de ce qu'il faut en retenir.

Beaucoup ne retiendront de l’évènement que les annonces matérielles, les plus visibles. Le Pixel 6a a été présenté, le 7 évoqué, et Google a révélé en grande pompe sa Watch qui était pressentie depuis longtemps, en plus d’un retour sur le marché des tablettes pour 2023, que l'entreprise avait quitté il y a des années. Nous avons abordé ces annonces dans LeBrief.

La Google I/O, comme toutes les conférences dédiées aux développeurs, cache cependant l’essentiel de ses annonces sur des blogs et autres sites techniques. L’édition 2022 n’a pas fait exception, avec quantité d’informations un peu partout. Elles concernent le plus souvent les technologies proposées par l’entreprise, mais touchent aussi à d’autres domaines comme la vie privée et la sécurité, voire à de simples nouvelles fonctions pour des services existants.

Android Studio, Jetpack, Firebase et Flutter

Android Studio a bien sûr été l’objet de toutes les attentions, l’environnement de développement étant au cœur de la stratégie de Google pour les applications Android. L’éditeur l’utilise d’ailleurs lui-même.

Les nouveautés à venir peuvent déjà être testées dans les deux branches de développement, Beta et Canary, avec des versions nommées respectivement Dolphin et Electric Eel, toutes deux récupérables depuis la page consacrée aux préversions.

Dolphin apporte son lot d’améliorations, avec les animations dans View Compose et leur coordination au sein d’Animation Preview, la création de classes d’annotations pour inclure et appliquer les vues Compose multiples, l’appairage d’émulateurs Watch OS multiples et leur utilisation pour l’ensemble des fonctions des montres, ou encore des diagnostics plus rapides dans les applications avec Logcat V2.

Electric Eel, de son côté, apportera une fonction attendue depuis longtemps : Live Edit. À la manière de Xcode chez Apple avec SwiftUI depuis deux ans environ, les développeurs pourront voir se refléter directement dans Compose Preview toute modification dans le code, qu’ils utilisent l’émulateur ou un appareil physique. Parmi les autres changements, signalons le Play SDK Index pour obtenir des renseignements supplémentaires sur les dépendances, l’intégration de Firebase Crashlytics ou encore la possibilité de redimensionner l’émulateur Android.

L’intégration de Crashlytics en particulier devrait faire gagner du temps, puisque les développeurs s’en servant n’auront plus besoin de faire des allers et retours entre Android Studio et l’outil. Ce dernier présentera ses informations dans une nouvelle fenêtre de Studio nommée App Quality Insights Window. Les informations sur les plantages s’y afficheront, de même que la ou les lignes de code les ayant causés.

Puisque l’on parle de Firebase, d’autres apports sont en approche. La commande « firebase deploy » veut par exemple simplifier le déploiement en déterminant automatiquement quoi faire avec les frameworks (Angular, Next.js, Vue…). On note aussi l’arrivée des Extension Events, qui permettent de personnaliser les flux liés aux Extensions, qui sont pour rappel des intégrations d’API tierces.

De nouvelles ont d’ailleurs été présentées, pour le marketing, la recherche et le traitement des paiements. App Check va vérifier quant à lui que le trafic entrant est bien ce qu’il prétend : une communication depuis une application du développeur sur un appareil authentique (la fonction s’interface avec l’API Play Integrity). Enfin, tous les plug-ins Firebase pour Flutter sont disponibles en version finale, la documentation Flutter étant disponible depuis Firebase pour faciliter le travail avec les deux.

Android Jetpack va recevoir lui aussi de multiples améliorations prochainement. Cette suite d’outils et de bibliothèques doit aider pour rappel les développeurs à suivre les meilleures pratiques, tout en produisant un code clair et fonctionnant de manière uniforme sur l’ensemble de la plateforme Android, tous appareils et toutes versions confondus.

Les améliorations se concentrent sur Compose, dont la bêta 1.2 apporte plusieurs nouveaux outils et API. Par exemple, JankStats permet d’analyser les performances d’une application, plus particulièrement les interactions dans l’interface. Des API permettront également de prendre en charge les polices téléchargeables et le glisser-déposer de données entre applications. On note aussi une amélioration des outils de benchmarking.

La bêta de JetckPack Compose prend également en charge les dernières nouveautés de Wear OS, y compris la Pixel Watch à venir. Objectif, préparer le terrain bien sûr et motiver les développeurs à proposer des versions adaptées de leurs applications. Comme chez Apple, la même application se déclinera alors en fonction des appareils.

Comme toujours avec les préversions, Google espère recueillir les avis des développeurs avant l’arrivée des nouveautés dans la branche stable. C’est particulièrement vrai pour la branche Canary, qui permet certes de tester les apports longtemps à l’avance, mais sans garantie que ces derniers se retrouvent dans la version stable suivante. Le fonctionnement est identique à Chrome.

Intelligence artificielle

Google avait dévoilé son modèle LaMDA (Language Model for Dialog Applications) durant la conférence I/O de l’année dernière. L’entreprise le présentait comme une avancée majeure : un modèle de langage génératif spécifiquement conçu pour le dialogue, et que Google nourrissait avec l’objectif de s’en servir pour son propre Assistant. Une démonstration avait d’ailleurs eu lieu, où Assistant était capable de tenir une conversion sur les chaussures à porter en randonnée.

Cette année, on a appris que les tests réalisés avec les employés de Google avaient permis de nombreuses remontées, conduisant à une hausse générale de la qualité des résultats et à une réduction des réponses erronées ou offensantes.

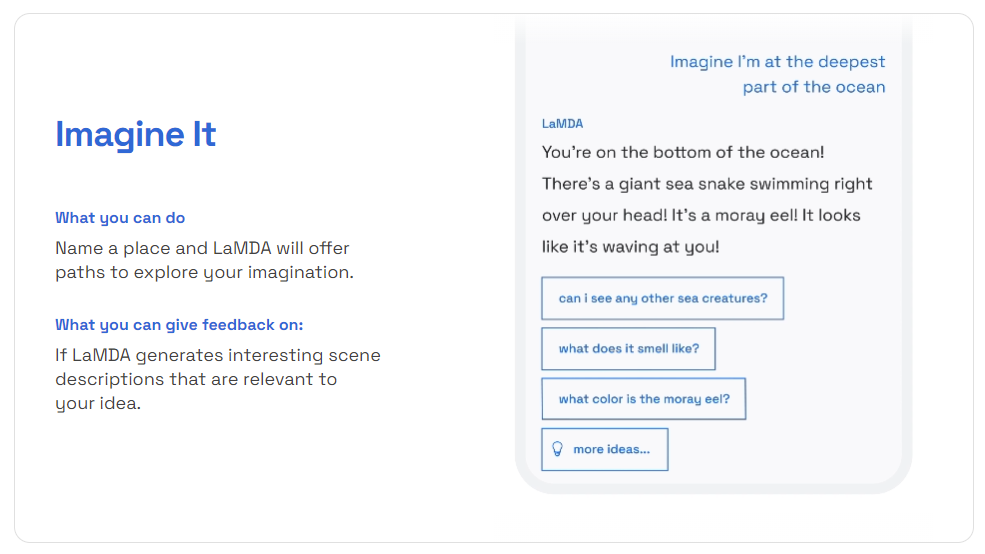

La société a donc présenté sans plus attendre LaMDA2, la nouvelle version du modèle prenant en compte ce qui a été appris. Elle se veut plus efficace et nettement moins sujette aux erreurs. Pour en explorer les capacités, Google mettra à disposition l’application AI Test kitchen. Elle permettra à tout un chacun de se faire une idée, même si la société a bien précisé que l’état du modèle était encore assez « brut ».

Trois expériences y seront présentes. « Imagine It » permettra de lancer une idée « créative » et d’observer comment le modèle peut parvenir à en faire une description « imaginative et appropriée ». Durant la conférence, des exemples ont été donnés : demander comment vivre dans les profondeurs océaniques se déroulerait, ou imaginer une planète faite… de crème glacée. Ce modèle particulier peut être amené à poser des questions complémentaires aux utilisateurs.

La seconde expérience, « Talk about it », est conçue pour tester la capacité de LaMDA2 à rester sur le sujet d’origine. La démonstration était simple : Sundar Pichai, PDG de Google, a lancé une conversation sur les chiens, puis a essayé de dévier sur les criquets, le modèle ne se laissant pas faire.

Quant au troisième modèle, « Listing It Out », il a pour mission de réagir au contexte et de dresser des listes de choses à faire. Dans l’exemple pris, le modèle recevait pour indication que du jardinage allait commencer et fournissait des informations « utiles » générales, en plus de pouvoir répondre sur des conseils plus précis, selon l’action entreprise.

Problème, on ne sait pas quand cette application sera disponible. Google a simplement indiqué qu’elle serait proposée graduellement à un nombre croissant de petits groupes.

On reste dans les modèles avec PaLM, pour Pathways Language Model. Il s’agit d’un nouveau modèle de traitement du langage, en fait le plus gros jamais créé chez Google, avec 540 milliards de paramètres pendant l’entrainement. S’appuyant sur une technique baptisée « chaines de pensées », il serait capable de comprendre les problèmes à étapes multiples, ces dernières étant considérées comme intermédiaires.

En plus d’avoir l’impact que l’on imagine sur la manière de poser des questions aux assistants vocaux, PaLM semble être capable d’expliquer des plaisanteries ou de répondre à des problèmes mathématiques. Il ne s’agit toutefois pas d’une nouveauté, mais de la poursuite de travaux présentés la première fois début avril.

Android 13

Nous n’allons pas détailler à nouveau ici les nouveautés d’Android, mais faisons tout de même un rappel des principales : un thème plus prononcé à l’échelle du système pouvant s’appuyer sur le fond d’écran et s’étendre aux icônes, la possibilité d’utiliser une langue différente selon le contexte, une amélioration du multitâche pour les tablettes, une simplification du passage en vue partagée, une meilleure reconnaissance des gestes tactiles involontaires quand on utilise un stylet, une meilleure utilisation de l’espace par les applications intégrées, etc.

Google a cependant profité de sa conférence I/O pour annoncer la Beta 2 d’Android 13. Les nouveautés se font plus rares, car on est maintenant proche de la stabilité des API. On note toutefois quelques améliorations dans les permissions, notamment pour les notifications et l’appairage aux appareils proches et l’accès aux médias. Citons en outre un sélecteur de photos plus sensible à la vie privée – comme sur iOS, on peut donner accès à tous les clichés ou uniquement une sélection – et le support natif du HDR.

On est toujours en attente de la page révisée des paramètres de sécurité. Elle devrait arriver dans une prochaine préversion, peut-être avec la Beta 3. Pour rappel, cette révision doit permettre une simplification des réglages, avec une présentation plus directe et accessible des informations.

Sécurité : cap sur l'authentification à deux facteurs

Plusieurs nouvelles fonctions de sécurité ont été annoncées. L’une d’elles, Account Safety Status, va afficher des cercles jaunes autour de l’avatar de l’utilisateur dans les applications de l’éditeur. Ils serviront à attirer son attention sur d’éventuelles mesures à prendre pour sécuriser son compte. De plus amples informations lui seront données dans les paramètres.

Dans la même veine, Google Workspace produira bientôt des alertes sur le risque de phishing face à certains documents dans Docs, Slide et Sheets.

Google prévoit également une offensive sur la vérification à deux facteurs. Il est plus que probable que ce renforcement soit lié à la récente annonce conjointe avec Apple et Microsoft au sein de l’alliance FIDO sur la simplification des étapes. Les utilisateurs seront ainsi invités à activer cette sécurité supplémentaire pour renforcer l’accès du compte Google. Au vu de ce que brasse ce dernier, c’est un pas dans la bonne direction.

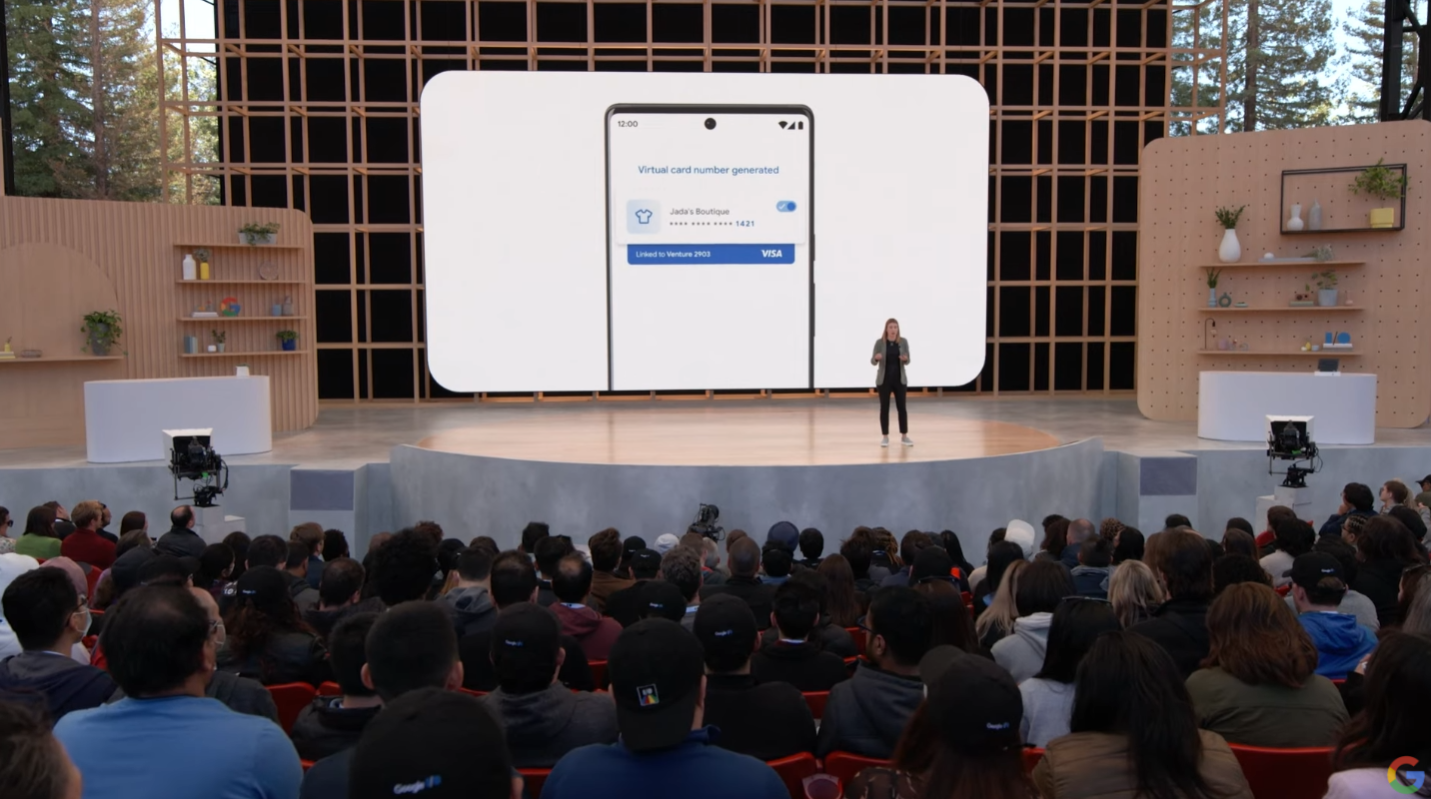

Les cartes virtuelles de paiement vont faire leur apparition. L’idée est d’intercaler une « fausse » carte au moment de payer, dont les caractéristiques sont héritées de la vraie. La fonction ressemble à ce que l’on trouve dans certains services email, capables de générer des adresses aléatoires liées au compte principal.

Après authentification, la carte ainsi créée servira au paiement, sans besoin d’ajouter des informations supplémentaires comme le code CCV. Cette fonction sera disponible dans Android et Chrome, d’abord aux États-Unis. Dans un premier temps, elle prendra en charge les cartes VISA, American Express et Capital One, avant une arrivée de Mastercard plus tard dans l’année.

Google a profité de son évènement pour faire aussi un point sur la guerre en Ukraine. L’entreprise a étendu son Project Shield aux sites de plus de 200 entités, dont des structures gouvernementales et médias. Toujours selon elle, son Threat Analysis Group suit au plus près l’activité cybercriminelle en Ukraine et transmet les informations au pays, ainsi qu’aux voisins et au reste de l’Europe. L’idée est toujours la même : bloquer autant que possible les cyberattaques et prévenir de ce qui se trame.

AlloyDB, nouveau système de base de données fondé sur PostgreSQL

Ce n’est pas tous les jours qu’une entreprise majeure de la tech lance une nouvelle solution de base de données. C’est le cas d’AlloyDB, bâtie sur les fondations de PostgreSQL et à destination de la Cloud Platform de Google.

Selon l’entreprise, AlloyDB est nettement plus rapide que sa grande sœur. Dans ses tests, Google aurait mesuré des performances 100 fois supérieures dans les requêtes analytiques. Sur le transactionnel, les performances seraient quatre fois supérieures à PostgreSQL et deux fois supérieures à Aurora d’Amazon.

Mais Google veut surtout faire la différence sur la simplicité tarifaire. Contrairement aux offres de Microsoft, AWS ou encore Oracle, les paramètres pris en compte seront plus restreints. Rien à payer donc sur les accès et sur le nombre d’IOPS (Input/Output Operations Per Second), ces dernières pouvant représenter 60 % de la facture, selon Google. Ce qui entrainerait mathématiquement une tarification agressive pour AlloyDB. On ne sait pas pour l’instant combien compte faire payer Google, car le service n’est pas finalisé. Une version d’essai gratuite est cependant disponible.

Basée sur PostgreSQL, AlloyDB garde une compatibilité totale avec l’actuelle version 14. Les bases peuvent donc être transférées telles quelles, sans modifications. Google souhaitait un produit capable d’attirer des clients pour lesquels ses offres existantes – CloudSQL for PostgreSQL and Spanner – n’étaient pas adaptées. Il lui fallait son propre service PostgreSQL, dans une version managée et capable d’utiliser pleinement son infrastructure, qui sépare le stockage du calcul.

Côté fonctions, on retrouve l’automatisation des tâches administratives (sauvegardes, réplication, patching, gestion de la capacité…) et une bonne dose de machine learning pour de nombreux aspects, dont PostgreSQL VACUUM, la gestion de l’espace de stockage et de la mémoire, la hiérarchisation des données, etc. Ces algorithmes interviennent dans le cadre de pilotes automatiques, donc au choix des administrateurs.

Google Wallet s'ouvre à toutes les cartes

Le portefeuille de Google est l’un des composants ayant reçu le plus d’annonces pendant les deux jours de la conférence.

L’une des plus importantes concerne l’API : ne l’appelez plus Google Pay for Passes, mais Google Wallet, tout simplement. Cette nouvelle interface est la réponse de l’entreprise face au Wallet d’Apple sur iOS, avec les mêmes enjeux. L’API peut ainsi être appelée pour stocker à peu près n’importe quelles cartes : paiement, fidélité, embarquement, tickets d’évènement, passes sanitaires, etc.

La nouvelle API permet en outre d’ajouter des éléments génériques. Pour les développeurs, l’accès se veut simple : s’il s’agit d’une information présentée sous forme de carte avec un peu de texte ainsi qu’un code barre ou QR, elle peut alors faire l’objet d’une carte générique intégrée dans Wallet.

Il est possible de définir une apparence personnalisée et d’afficher des informations présentées sur trois lignes d’un maximum de trois colonnes. Les développeurs peuvent en outre groupes les cartes. Google donne l’exemple d’un ticket de concert, accompagné d’un autre pour le parking et un bon pour un repas.

Pour en profiter, il faut obligatoirement la dernière révision du SDK Android. La documentation a été adaptée en conséquence, des conseils étant donnés pour chaque type de données que l’on souhaite intégrer dans Wallet.

Google a également lancé sa Google Pay & Wallet Console. Le profil et le tableau de bord sont unifiés, la console permettant de réunir au même endroit tout ce qui touche aux paiements. Elle autorise en outre le lien entre les cartes ajoutées dans Wallet et Google Pay, les développeurs pouvant déclarer leurs « passes » comme moyens de paiement. S’ils sont reconnus, ils pourront être utilisés par Pay en NFC.

Recherche, traduction et Maps

Certaines nouveautés ne concernaient pas directement les développeurs et se rapprochaient davantage des utilisateurs finaux. Par exemple, l’arrivée de 24 nouvelles langues dans Translate, allant du sanskrit (parlé par environ 20 000 personnes en Inde) au lingala (environ 45 millions de personnes au sein des deux Congo, en République centrafricaine, en Angola et en Soudan du Sud).

Autre nouveauté, la recherche multiple dans Google, pour l’instant en bêta et uniquement aux États-Unis. Elle permet l’utilisation conjointe d’une image et de texte pour fournir du contexte. L’idée serait de reproduire la même situation que lorsque l’on pointe son doigt vers quelque chose pour demander à une personne de quoi il s’agit.

Cette capacité sera étendue par la suite par une extension de Google Lens à l’intégralité du champ visuel du smartphone. Au lieu de se limiter à quelques éléments identifiés, Lens pourra en effet fournir des informations sur l’ensemble de ce qui est observé par la caméra.

Maps va de son côté recevoir une fonction annoncée en grande pompe : une vue immersive ambitionnant de nous faire profiter de ce qu’est vraiment un quartier ou une ville avant d’y mettre les pieds. La fonction promet de pouvoir entrer partout où le public peut se rendre, dans une vue plongeante techniquement très réussie. On peut aussi examiner les monuments et bâtiments sous toutes les coutures.

La bonne nouvelle, c’est que cette fonction ne réclame aucune condition particulière de navigateur ou d’appareil. Elle viendra s’ajouter au Google Maps existant. La mauvaise est qu’elle ne sera disponible que plus tard dans l’année pour un nombre limité de villes : Los Angeles, Londres, New York, San Francisco et Tokyo. D’autres seront annoncées « bientôt », a indiqué Google.

En Europe, Maps recevra bientôt la fonction permettant de minimiser la consommation de carburant. Elle avait été lancée en mars 2021 aux États-Unis, avant d'être étendue au Canada.

Maps a quand même une nouvelle pour les développeurs : l’arrivée de l’API Geospatial pour ARCore. Traduction, en plus de Street View déjà disponible pour les applications, ces dernières pourront intégrer Live View. Il s’agit pour rappel de la fonction permettant d’afficher des informations en réalité augmentée sur ce que la caméra regarde. L’API commence déjà à être utilisée, par exemple par Telstra et Accenture pour aider les personnes se rendant à des concerts ou évènements sportifs à trouver leurs sièges.

Vie privée : grandes ambitions, petits gestes

La vie privée a fait l’objet d’un discours. Jen Fitzpatrick, vice-présidente de l’entreprise, a en personne abordé cette partie, sur laquelle l’entreprise est souvent attendue de pied ferme.

Selon elle, la philosophie de Google est simple : réduire autant que possible l’empreinte des données personnelles. Cette philosophie porte d’ailleurs un nom, « Protected Computing ». Elle s’accompagne d’ailleurs d’un mantra : « Si les données n’existent pas, elles ne peuvent pas être piratées ». Et pour parvenir à ce résultat, il faut « collecter moins, effacer davantage ».

Un discours rodé et une logique implacable. Sur le terrain des annonces concrètes cependant, si l’on met de côté des renforcements sur les autorisations dans Android 13, la firme ne pouvait revenir que sur l’arrivée récente de son outil pour supprimer les références personnelles dans ses résultats de recherche. On peut en effet se lancer dans cette procédure dès lors qu’elles représentent un risque de phishing ou de « doxxing », c’est-à-dire un partage des informations à des fins malveillantes.

Plus généralement, et bien que les développeurs aient été largement fournis en nouveautés, cette conférence avait un parfum différent des autres années. Les annonces, en particulier matérielles, étaient moins fournies et surtout plus floues. Seul le Pixel 6a ressort du lot, puisque tous les autres arriveront plus tard, avec très peu d’informations à se mettre sous la dent.

Google I/O : tout ce qu’il faut retenir de l’édition 2022

-

Android Studio, Jetpack, Firebase et Flutter

-

Intelligence artificielle

-

Android 13

-

Sécurité : cap sur l'authentification à deux facteurs

-

AlloyDB, nouveau système de base de données fondé sur PostgreSQL

-

Google Wallet s'ouvre à toutes les cartes

-

Recherche, traduction et Maps

-

Vie privée : grandes ambitions, petits gestes

Commentaires (5)

Vous devez être abonné pour pouvoir commenter.

Déjà abonné ? Se connecter

Abonnez-vousLe 17/05/2022 à 13h32

Le 17/05/2022 à 13h52

Concernant AlloyDB la page des tarifs est ici : Google

Google

Le 17/05/2022 à 18h14

le poing fermé sauf le majeur bien tendu

Le 17/05/2022 à 20h46

Espérons que les autres gros suivront pour ne pas trop se faire distancer techniquement, notamment sur l’ai

Le 18/05/2022 à 07h00